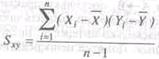

Проверка гипотез о связях, если речь идет о более чем одной переменной, предполагает одновременные изменения и измерения их безотносительно к указаниям направленности влияний (какая из переменных рассматривается как влияющая на другую). Статистической мерой связи служит при этом выборочный коэффициент ковариации S xy. Он подсчитывается как среднее произведений отклонений каждой переменной:

Именно ковариация характеризует связь двух переменных Х и Y.

Ковариация дает количественную характеристику диаграммы рассеивания, на которой переменные обозначены осями, а отдельные наблюдения, т.е. полученные эмпирические данные, – точками в прямоугольной системе координат. Множество точек образует «облако», по форме которого судят о связи переменных Х и Y.

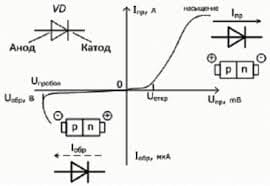

Если связь положительна, то более высоким значениям одной переменной (X) чаще соответствуют и более высокие значения другой переменной (Y). Этот случай представлен на рис. 12.1. Чем больше по величине коэффициент корреляции, тем более вытянутым выглядит на диаграмме рассеивания это «облако» данных.

Заметим, что ковариация переменной с самой собой – это дисперсия.

Рис.12.1. Диаграмма рассеивания.

При обсуждении трех основных условий причинного вывода применительно к экспериментальным данным речь идет также о ковариации независимой и зависимой переменных. Однако здесь подразумевается неслучайность характера связи между изменениями этих переменных, а не необходимость подсчета коэффициентов ковариации или корреляции. Для количественной оценки экспериментально полученных эффектов обычно используются меры различий, а не меры связей. В корреляционном по способу сбора данных исследовании предпочтение отдается коэффициенту корреляции как более удобному способу количественной оценки величины связи.

Корреляция есть отношение полученной ковариации к максимально возможной:

где r – процент от максимально возможной ковариации, которая в данном эмпирическом исследовании достигнута.

Другое определение коэффициента корреляции: корреляция есть ковариация стандартизованных переменных. Обозначение r происходит от понятия регрессии. Ф. Гальтон и К. Пирсон использовали его в исследованиях регрессии физических измерений от одного поколения к другому. Это обозначение закрепилось за коэффициентом корреляции Пирсона, основанном на подсчете произведения моментов, в то время как другие коэффициенты корреляции закрепили за собой другие обозначения (φ – «фи»-коэффициент, τ – «тау» Кендэлла и др.). Коэффициент регрессии также имеет разные обозначения, в том числе и r.

В отличие от коэффициентов ковариации и корреляции, которые направлены на установление меры связи между переменными, коэффициент рефессии используется для цели предсказания одной переменной по данным другой. При этом становится важным определиться, значение какой из переменных – Х или Y – служит для предсказания значений другой. Это отражается в указании последовательности х и у в индексе коэффициента регрессии. Соответственно коэффициенты регрессии с разным порядком следования переменных в индексации будут иметь разные величины, в то время как для коэффициентов ковариации и корреляции указание последовательности переменных в индексе не имеет значения, так как это будет одна и та же величина связи.

2015-03-20

2015-03-20 538

538