Энтропия опыта равна той информации, которую получаем в результате его осуществления.

Отметим ряд свойств информации: 1. /(α, β) ≥ 0, причем /(α, β) = 0 тогда и только тогда, когда опыты α и β независимы. Это свойство непосредственно вытекает из (2.10) и (2.13). 2. /(α, β) = /(β, α), т.е. информация симметрична относительно последовательности опытов. 3. Следствие 2 и представление энтропии в виде (2.4) позволяют записать:

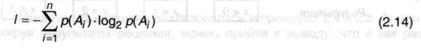

т.е. информация опыта равна среднему значению количества информации, содержащейся в каком-либо одном его исходе. Рассмотрим ряд примеров применения формулы (2.14). |

|

Вернуться в оглавление: Теоретические основы информатики |

Сейчас читают про: