Большие данные (Big Data, биг дата) — это структурированные и неструктурированные данные огромных объемов и разнообразия, а также методы их обработки, которые позволяют распределённо анализировать информацию. Из самого определения следует, что большие данные – не технология, а явление, состоящее из большого количества данных и многих технологий их сбора, хранения и обработки. Ценность этого явления сегодня сложно переоценить: сравнивая большие данные, можно найти неочевидные закономерности. Чем больше вы знаете об объекте исследования, тем более точно вы сможете построить прогнозы о его будущем развитии и/или поведении.

С начала своего появления, большие данные обладали тремя определяющими характеристиками:

· Volume – объем как большая величина физического объема данных;

· Velocity – скорость, в смысле как скорости прироста необработанных данных, так и необходимости их высокоскоростной обработки и получения результатов анализа в реальном масштабе времени;

· Variety – разнообразие, в смысле необходимости обработки не только структурированной информации, но и неструктурированных данных всех типов: аудио, видео, изображения, текстовые файлы, а также смесь информации, полученной из различных источников.

Со временем появились и другие характеристики:

· Variability (переменчивость, изменчивость) – значение одних и тех же данных может различаться в зависимости от контекста;

· Veracity (достоверность) – информация должна быть избавлена от ошибок и неточностей в данных, которые могут привести к неправильным решениям;

· Viability (жизнеспособность) – устойчивость к условиям использования;

· Virality (виральность) – стремительность распространения среди пользователей;

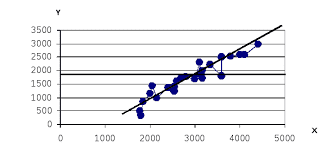

· Visualization (визуализация) – возможность представления результатов анализа данных в наглядном виде;

На самом деле, очень сложно дать точное определение явлению Больших данных, но есть аспекты, которые признаны свойствами и признаками больших данных в наши дни:

· Данные:

o Объем генерируемых данных растет со скоростью более 60% в год;

o Объем накопленных данных превышает 1000 Тб;

o Два или более источника/формата данных, откуда следует:

o Неструктурированность, многообразность форматов;

· Инфраструктура:

o Анализ/обработка данных разворачиваются на динамически адаптируемой инфраструктуре, откуда следует:

o Специальные требования к технологиям обработки информации;

o Распределенная/параллельная обработка данных: используется много компьютеров, существует специальная сложная система одновременной (параллельной) обработки поступающей информации.

Стремительный рост объема данных и требования к скорости обработки сделали необходимым создание новой схемы работы с данными, разительно отличающейся от прежней:

| Традиционный подход | Работа с большими данными |

| Бизнес задаёт вопрос (ежемесячная отчетность, анализ прибыли, анализ анкет), информационный отдел считает по заказу и структурирует данные для ответа. | Непрерывный сбор как можно большего количества данных, их первичная и более глубокая обработка и загрузка результатов в хранилище данных. После этого бизнес исследует эти данные. Вопросы (отношение к бренду, оптимизация расходов, персонализация) возникают в ходе обработки данных. |

Явление требует новых методов и технологий обработки такого большого объема данных, таких как:

· Методы:

o Методы класса Data Mining – интеллектуальный анализ данных, обнаружение в данных новых практически значимых знаний, полезных для принятия решений в будущем;

o Машинное обучение – методы построения компьютерных алгоритмов, способных обучаться решению поставленной задачи;

o Предсказательная аналитика – класс методов анализа данных, концентрирующихся на прогнозировании будущего поведения объектов и субъектов с целью принятия оптимальных решений;

o Распознавание образов – ставятся задачи идентификации объекта или определения каких-либо его свойств по его изображению, аудиозаписи или другим характеристикам;

o Имитационное моделирование – метод исследования, при котором изучаемая система заменяется моделью, с достаточной точностью описывающей реальную систему, с которой проводятся эксперименты с целью получения информации об этой системе;

o Визуализация аналитических данных – представление информации в виде рисунков, диаграмм, с использованием интерактивных возможностей и анимации как для получения результатов, так и для использования в качестве исходных данных для дальнейшего анализа.

· Технологии:

o MapReduce – созданная компанией google платформа программирования и модель выполнения распределенных вычислений в компьютерных кластерах, а также её реализации, используемые для параллельной обработки больших объемов данных;

o Apach Hadoop (Apach Software Foundation) – свободно распространяемый Java фреймворк (программная платформа), предназначенный для разработки и выполнения распределенных программ, работающих на кластерах из сотен и тысяч узлов;

o NoSQL (SQL – язык структурированных запросов) – термин, обозначающий ряд подходов, направленных на реализацию систем управления базами данных, имеющих существенные отличия от моделей, используемых в традиционных реляционных СУБД с доступом к данным средствами языка SQL. К NoSQL (Not Only SQL) относятся множество разнородных систем, призванных решать проблемы масштабируемости, доступности и параллельной обработки больших объемов данных – способ работы с неструктурированными данными.

§ Базы данных следующего поколения в основном ориентированы на содержание следующих свойств: нереляционные, распределенные, с открытым кодом, горизонтально масштабируемые;

o Язык программирования R – язык программирования для статистической обработки данных и работы с графикой. Появился до возникновения больших данных, но успешно используется для работы со статистической обработкой данных. Поддерживает широкий спектр статистических и численных методов, обладает хорошей расширяемостью за счет пакетов, используется для массово-параллельной обработки данных.

2020-01-14

2020-01-14 271

271