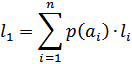

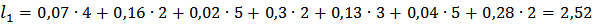

Cреднее число двоичных символов  на одно сообщение алфавита объемом n, определяется выражением:

на одно сообщение алфавита объемом n, определяется выражением:

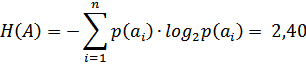

Энторопия – мера неопределенности в поведении источника сообщений.

Она равна нулю, если с вероятностью равной единице источником выдается всегда одно и то же сообщение.

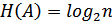

Энтропия максимальна, если сообщения выдаваемые источником появляются независимо и с одинаковой вероятностью и равна:

=2,81

=2,81

Kcc - коэффициентом статистического сжатия, который характеризует уменьшение числа двоичных символов на знак при применении методов эффективного кодирования по сравнению с применением равномерного кода;

Kcc =  =

=  = 1,3015

= 1,3015

lo- средняя длина кодовой комбинации при равномерном кодировании

Koэ - коэффициентом относительной эффективности, который показывает степень близости средней длины кодовой комбинации к теоретически возможному пределу H(A)

Koэ =  =

=  = 0,95

= 0,95

2015-05-10

2015-05-10 469

469