Как уже отмечалось ранее, каким бы точным и совершенным не были методы и средства измерений и как бы тщательно измерения не выполнялись, их результат всегда является реализацией случайной величины, равной сумме истинного значения измеряемой величины и погрешности измерений[1].

Погрешность результата измерения - отклонение результата измерения от истинного (действительного) значения измеряемой величины[5].

D = хизм - хи, (1)

где хизм - измеренное значение величины, хи – истинное значение измеряемой величины.

Однако, так как истинное значение величины неизвестно, это понятие используют только в теоретических исследованиях. На практике используют действительное значение величины хд, в результате чего погрешность измерения D определяют по формуле[5]:

D = хизм - хд. (2)

Действительное значение физической величины - значение физической величины, полученное экспериментальным путем и настолько близкое к истинному значению, что в поставленной измерительной задаче может быть использовано вместо него[5].

Точность результата измерений (точность измерений) - одна из характеристик качества измерения, отражающая близость к нулю погрешности результата измерения[5].

Классификация погрешностей носит достаточно условный характер. На практике в зависимости от решаемых задач могут использоваться много различных классификационных признаков и различающихся классификационных схем. В данной лекции используется с некоторыми коррективами схема, приведённая в [6] (раздел 2.2.).

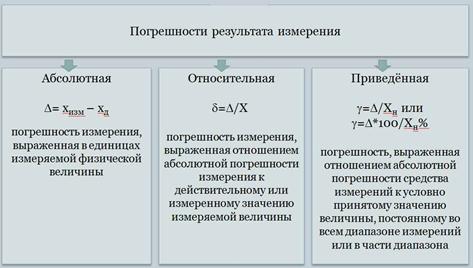

1.1. По форме количественного выражения погрешности подразделяются на абсолютные, относительные и приведённые.

Рис.1.Классификация погрешностей по форме количественного выражения

Абсолютная погрешность средства измерений - погрешность измерения, выраженная в единицах измеряемой физической величины[5].

С помощью выражения (2) производится вычисление именно абсолютной погрешности.

Однако на практике достаточно часто имеет значение не величина абсолютной погрешности измерения, а отношение этой погрешности к значению измеряемой физической величины. Например, если абсолютная погрешность при измерении напряжения равна 0,5 В, то при измеряемом напряжении в 1000 В такая погрешность допустима для большинства задач, решаемых в ходе эксплуатации техники связи и автоматизации. В то же время, если измеряемое напряжение равно 1 В, то эта же абсолютная погрешность совершенно не приемлема.

Поэтому, наряду с абсолютной погрешностью, для оценки «качества» измерения используется так называемая «относительная погрешность».

Относительная погрешность измерения (относительная погрешность) - погрешность измерения, выраженная отношением абсолютной погрешности измерения к действительному или измеренному значению измеряемой величины[5].

Рассчитывается относительная погрешность по формуле:

d=D/Х (3)

где Х это или истинное или действительное значение измеряемой физической величины.

В случае, когда рассматривается погрешность измерительного средства, поимо абсолютной и относительной погрешности, часто используют понятие приведённой погрешности.

Приведённая погрешность — погрешность, выраженная отношением абсолютной погрешности средства измерений к условно принятому значению величины, постоянному во всем диапазоне измерений или в части диапазона[6].

Приведённая погрешность вычисляется по формуле:

g  *100% или g

*100% или g  (4)

(4)

где Хн - нормирующее значение, которое зависит от типа шкалы измерительного прибора.

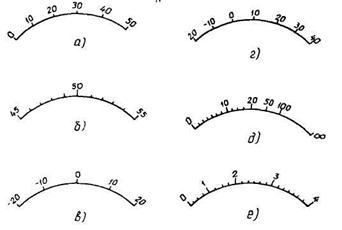

Различают равномерные[18] (рис. 2а, б, в, г) и неравномерные[19] шкалы.

Нормирующее значение Хн принимается равным [7]:

- конечному значению рабочей части шкалы Хн = Хк, если нулевая отметка – на краю или вне рабочей части шкалы (равномерная шкала рис. 2а – Хн = 50; рис. 1б – Хн = 55; степенная шкала – Хн = 4 на рис. 2е);

- сумме конечных значений шкалы (без учета знака), если нулевая отметка – внутри шкалы рис. 1в, Хн = 20+20 = 40; рис. 2г, Хн = 20+40 = 60;

- длине шкалы, если она существенно неравномерна. В этом случае, поскольку длинаХн выражается в миллиметрах, то абсолютную погрешность надо выражать также в миллиметрах (рис.2д).

|

|

|

|

|

|

|

Рис. 2. Виды шкал СИ

В других случаях указания по выбору нормирующего значения должны быть приведены в стандартах на средства измерений конкретного вида[7].

Приведённая погрешность имеет одно, но очень важное преимущество перед абсолютной и относительной погрешностями. Её значение не зависит от значения измеряемой физической величины и поэтому это значение можно указать в технической документации.

1.2. По причине возникновения погрешности подразделяются на методические или погрешности метода измерения, инструментальные, внешние (Погрешность из-за изменений условий измерения) и субъективные[6][20].

2015-03-20

2015-03-20 2148

2148