Сеть РБФ (радиальная базисная функция) является аналогом многослойного персептрона (рис. 3.1). Скорость обучения такой сети гораздо выше, причем допускается полностью аналитический подход к расчету весовых коэффициентов. Однако эти положительные моменты сопровождаются рядом недостатков, главным из которых является ухудшение точности аппроксимации. Сеть обладает хорошей обобщающей способностью только для ограниченного класса аппроксимируемых функций. В качестве классификатора такая сеть может с успехом применяться в случае хорошей кластеризации классов в пространстве признаков.

Рис. 3.1. Топология сети РБФ

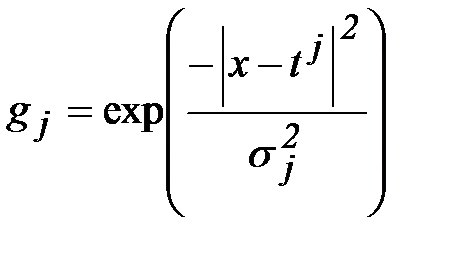

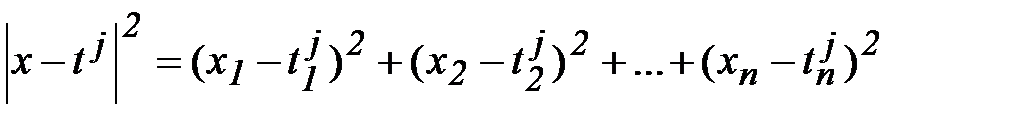

Упрощение работы и обучения достигается за счет введения вместо скрытого слоя нейронов слоя РБФ ячеек. Классический закон, по которому такая ячейка функционирует, определяется формулой гауссового колокола:

, (3.1)

, (3.1)

где x – входной вектор; t j – вектор, определяющий математическое ожидание (центр кластера в пространстве признаков) РБФ ячейки; sj – среднеквадратическое отклонение или параметр, зависящий от величины разброса образов класса от его центра (рис. 3.1). В данном выражении евклидово расстояние между векторами x и t j вычисляется как

.

.

Обучение. РБФ ячейки обучаются путем подбора центра и отклонения каждой из них. Для классификатора в качестве центра выбирается центр кластера в пространстве признаков, компактно содержащего образы одного и того же класса. В простейшем случае, если класс задается одним идеальным образом, этот образ и будет являться вектором t – центром РБФ ячейки. Параметр разброса каждой ячейки выбирается в зависимости от величины радиуса кластера или расстояния до соседних центров. Ряд авторов рекомендует выбирать s как половину расстояния до ближайшего центра ячейки, соответствующей другому классу. Количество РБФ ячеек выбирается таким образом, чтобы покрыть гауссовыми колоколами все классы.

>

Рис. 4.2. Примеры функций РБФ ячеек

с одинаковым центром и разным разбросом

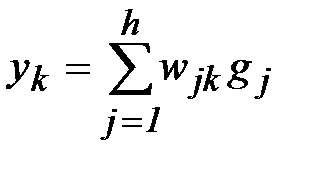

Выходной слой РБФ сети обычно состоит из суммирующих ячеек

. (3.2)

. (3.2)

Это позволяет при определенных условиях использовать систему линейных уравнений для определения весов выходного слоя. В других обстоятельствах можно использовать алгоритм градиентного спуска для настройки весов выходного слоя (функция активации в данном случае линейная). С учетом того что обучается только выходной слой нейронной сети, а скрытый уже настроен, обучение такой сети проходит на порядок быстрее, чем аналогичного многослойного персептрона.

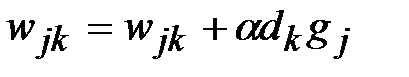

В случае обучения выходного слоя по алгоритму градиентного спуска формулы расчета из лабораторной работы 2 значительно упрощаются. Формулы (2.1) и (2.2) заменяются соответственно на (3.1) и (3.2). Формула (2.13) упрощается до

, (3.3)

, (3.3)

поскольку функция активации в выходном слое сети РБФ линейная и ее производная равна 1. Для коррекции весовых коэффициентов выходных суммирующих ячеек используется только (3.3).

Контроль завершения алгоритма обучения производится аналогично.

Воспроизведение. Сеть функционирует по формулам (3.1) и (3.2).

Очевидно, что функция на выходе РБФ сети будет представлять собой суперпозицию гауссовых колоколов. В этом заключается ограничение данного класса классификаторов. Кроме этого, при неудачном выборе признаков большой проблемой является выбор количества РБФ ячеек, определение их центров и отклонения. С уменьшением числа РБФ ячеек улучшается обобщение данных сетью, но могут проявляться большие ошибки в эталонных точках.

2015-04-12

2015-04-12 476

476