Теперь представим себе, что статический канал КПДС не имеет кодера источника, то есть что избыточность источника ДИС не снята. Например, при наборе текста на клавиатуре ПК. Как лучше всего в таком случае закодировать дискретные (знаковые) элементарные сообщения { uj }  источника ДИС соответствующими уровнями цифро-аналогового преобразователя?

источника ДИС соответствующими уровнями цифро-аналогового преобразователя?

Наиболее рационально, как в алгоритмах Шеннона-Фано и Хаффмена, расставить сообщения uj ( j = 1, 2, …, N ) по убывающим вероятностям Pj, а затем (например при нечётном значении N ): первому сообщению u 1 присвоить значение нулевого уровня U 0 = 0, второму u 2 – первого уровня U 1 = Δ u, третьему u 3 – значение уровня U –1 = – Δ u, четвёртому U 2 = 2 Δ u и т. д.

Тогда распределение получившихся уровней  можно будет ап-

можно будет ап-

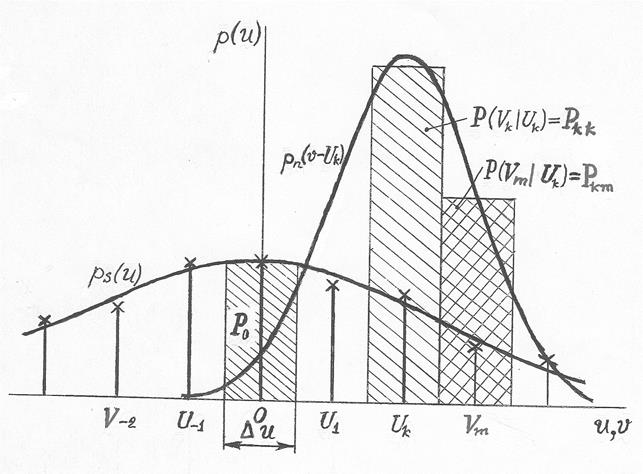

проксимировать подходящим законом распределения с плотностью вероятности ps (u) (см. рис. 22). При этом Pk ≈ ps (Uk) Δ u.

К. Шеннон доказал (см. [46], с. 297), что при одной и той же дисперсии источники сообщений с гауссовским распределением уровней ps (u) обладают наибольшей среди всех возможных источников дифференциальной энтропией (см. разд. 11).

Вернёмся к формуле (7.4) или (8.2) для количества информации на выходе канала КПДС. В ней будут фигурировать величины Pk m = P (Vm | Uk) переходной матрицы П канала КПДС, то есть вероятность того, что при подаче на вход канала КПДС k -го уровня сигнала Uk на его выходе, после квантования уровней выходных сигналов, появится уровень Vm, соответствующий m -му уровню выходного сигнала. Такие ошибки вызываются воздействием, например, аддитивных, не зависимых от сигнала помех, которые имеют плотность вероятности pn (x). Поэтому (см. рис. 22)

Pk m = P (Vm | Uk) ≈ pn (Vm – Uk) Δ v.

При такой постановке задачи оценки элементов Pk m переходной матрицы П мы можем теперь рассматривать воздействие на канал КПДС помех общего

вида (не обязательно гауссовских).

Рис. 22. Распределение уровней сигнала Uk и помех p п(u)

Рис. 22. Распределение уровней сигнала Uk и помех p п(u)

в статической системе передачи дискретных сообщений ССПИ

Найдём среднее количество информации на выходе такого канала КПДС:

.

.

Заметим, что по формуле полной вероятности

P'm = P (Vm) =

где w – вспомогательная переменная интегрирования, как индекс l в формуле для P'm.

Кроме того,  .

.

Значит,

.

.

При Δ u → 0 и Δ v → 0 получаем:

. (13.1)

. (13.1)

Поскольку интегрирование ведётся в бесконечных пределах, то

,

,

где h (n) – дифференциальная энтропия помехи (см. разд. 11).

Значит, второе слагаемое в выражении (13.1) есть:

J2 = –  .

.

В первом слагаемом J1 выражения (13.1) поменяем между собой порядок интегрирования по переменным v и u; получим:

J1 =  .

.

Если функцию  переменной v обозначить через p (v), то интеграл J1 = –

переменной v обозначить через p (v), то интеграл J1 = –  формально является некоторой

формально является некоторой

дифференциальной энтропией, содержащей плотности вероятности ps (u) и pn (x), где x = v – u, если функция p (v) является плотностью вероятности некоторой случайной величины v.

Тогда для среднего (на входной знак) количества информации

при Δ u → 0 и N → ∞ получаем асимптотическое выражение:

≈ h (s + n) – h (n), (13.2)

≈ h (s + n) – h (n), (13.2)

где h (s + n) = –  , а p (v) =

, а p (v) =  .

.

Покажем, что функция p (v) является плотностью вероятности суммы случайных величин уровней сигнала u на входе канала КПДС и шума n в этом канале.

Действительно. Сделаем замену переменных: u = x, v = x + y. Якобиан

(коэффициент изменения элементарной площади на плоскости { x, y }) такого-

преобразования равен:  .

.

Поэтому p αβ(u, v) = p αβ(x, y).

Чтобы получить плотность вероятности величины v = x + y, нужно проинтегрировать плотность вероятности p αβ(u, v) по переменной u = x. Но y = v – x =

= v – u; поэтому, возвращаясь к исходной системе координат { x, y }, получим:

p (v) =

Если случайные величины α и β – независимы, то p αβ(u, v) = p α(u) p β(v).

Поэтому p (v) =  , что и требовалось доказать.

, что и требовалось доказать.

Отсюда следует, что

среднее количество информации (бит / знак), которое получается

на выходе канала КПДС, имеющего аддитивные помехи

(не зависимые от уровней сигналов),

и которое приходится на один знак источника не-равновероятных

дискретных сообщений ДИС U = { uj }  (при N >> 1 и Δ u << σ s),

асимптотически равно разности дифференциальных энтропий

суммы уровней сигналов и помехи на выходе канала КПДС

и аддитивной помехи в канале КПДС.

Дифференциальная энтропия гауссовской помехи h (n) = (при N >> 1 и Δ u << σ s),

асимптотически равно разности дифференциальных энтропий

суммы уровней сигналов и помехи на выходе канала КПДС

и аддитивной помехи в канале КПДС.

Дифференциальная энтропия гауссовской помехи h (n) =  . .

|

Пусть аппроксимация ps (u) имеет также гауссовскую форму, то есть пусть

ps (u) =  exp

exp  .

.

Поскольку v = u + x, то при независимости уровней сигналов и помех величина D (v) = Ds + Dn. Отсюда дифференциальная энтропия уровней на выходе

канала КПДС h (v) =  .

.

Значит,  ≈ h (s + n) – h (n) =

≈ h (s + n) – h (n) =  –

–  ,

,

или  ≈

≈  log [(P + N )/ N ] =

log [(P + N )/ N ] =  log (1 + P / N ) =

log (1 + P / N ) =  log (1 + Q),

log (1 + Q),

или  ≈

≈  log (1 + Q) =

log (1 + Q) =  , (13.3)

, (13.3)

где P ≡ Ds – «мощность сигнала», N ≡ Dn – «мощность аддитивной помехи»,

Q = Ds / Dn = P / N – «отношение сигнал/помеха».

Как видим, величина  в этом случае не зависит от величиныкванта Δ u, поскольку в полученных асимптотических формулах Δ u → du → 0. То есть она является собственной характеристикой канала КПДС, равной максимальному среднему количеству информации на один уровень напряжения (или тока) в канале КПДС, которое возможно при заданном отношении средней мощности сигнала к средней мощности помех Q = Ds / Dn, то есть равной информационной ёмкости «непрерывного гауссовского канала» КПДС:

в этом случае не зависит от величиныкванта Δ u, поскольку в полученных асимптотических формулах Δ u → du → 0. То есть она является собственной характеристикой канала КПДС, равной максимальному среднему количеству информации на один уровень напряжения (или тока) в канале КПДС, которое возможно при заданном отношении средней мощности сигнала к средней мощности помех Q = Ds / Dn, то есть равной информационной ёмкости «непрерывного гауссовского канала» КПДС:

ℰШ(Q) =  = [log (1 + Q)]/2 =

= [log (1 + Q)]/2 =  .

.

На рис. 23 кривая 1 показывает зависимость ℰШ(Q) графически.

Впервые формулу (13.3) обосновал в 1948 г. К. Шеннон ([46], с. 243-332 – см. Прил. 4). Формулу (13.3) назовём центральной формулой Шеннона информационной статики.

Эта формула, как и формула для информационной ёмкости телеграфной системы без избыточности: ℰ(Q) ≈  , – справедлива при бесконечно малой величине кванта ( расстоянию между уровнями): при Δ u → 0.

, – справедлива при бесконечно малой величине кванта ( расстоянию между уровнями): при Δ u → 0.

Для того чтобы использовать формулу Шеннона (13.3) на практике, нужно определить эквивалентное количество уровней N Ш э(Q) и получающуюся при этом практическую информационную ёмкость ℰШ э(Q) шенноновской статичес-кой системы передачи дискретной информации.

Будем исходить из того, что для симметричного бинарного канала передачи сообщений два симметричных уровня (– U Т) и (+ U Т) можно аппроксимировать какой угодно (симметричной относительно нуля u = 0) плотность вероят-

C N э

C N э

бит

знак

знак

4 C Ш (Q)

4 C Ш (Q)

3 30 1 C Шэ (Q)

3 30 1 C Шэ (Q)

| |||

| |||

2 20 2 N Шэ (Q)

2 20 2 N Шэ (Q)

|

1 10 4 3

1 10 4 3

|

0

0

1 3 10 30 100 300 Q

Рис. 23. Характеристики шенноновской системы

передачи дискретных сообщений

ости ps (u). Отличие шенноновской системы (обе плотности вероятности: ps (u) и pn (u) – гауссовские) от рассмотренного выше «многоуровневого телеграфа» скажется при  ≥ 3, то есть при Q ≥ 8.

≥ 3, то есть при Q ≥ 8.

В промежутке (1/2 < Q < 2) характеристики шенноновской системы с конечным количеством уровней должны совпадать с аналогичными характеристиками «многоуровневого телеграфа» с источником ДИС без избыточности, то есть эквивалентное количество уровней определяется приближённой формулой

, а эквивалентная ёмкость шенноновской системы ℰШ э(Q) получа-ется путём «припассовки» (подгонки) кривой ℰ(Q) ≈

, а эквивалентная ёмкость шенноновской системы ℰШ э(Q) получа-ется путём «припассовки» (подгонки) кривой ℰ(Q) ≈  , в промежутке (1/2 < Q < 2) к зависимости от величины Q симметричного бинарного канала КПДС ℰ = 1 + p log p + (1 – p) log (1 – p) – см. формулы (10.1), (9.3) и рис. 11.

, в промежутке (1/2 < Q < 2) к зависимости от величины Q симметричного бинарного канала КПДС ℰ = 1 + p log p + (1 – p) log (1 – p) – см. формулы (10.1), (9.3) и рис. 11.

На рис. 23 показаны также зависимость от величины Q значения эквивалентного источнику ДИС без избыточности количества уровней  , а на рис. 21 – для сравнения с «многоуровневым телеграфом»

, а на рис. 21 – для сравнения с «многоуровневым телеграфом»

– информационная надёжность χШ(Q) шенноновской системы передачи дискре-

тных сообщений (пунктир).

Из рис. 20, 21 и 23 следует:

а) при снятой избыточности источника ДИС и аддитивных гауссовских помехах в канале КПДС оптимальная величина кванта составляет Δ u 0 = 2 W = = 2  σ n

σ n  3,47 σ n, а величина практической информационной ёмкости канала КПДС ℰ(Q) как функция величины отношения сигнал/помеха Q имеет вид (кривая 1 на рис. 20)ℰ(Q) =

3,47 σ n, а величина практической информационной ёмкости канала КПДС ℰ(Q) как функция величины отношения сигнал/помеха Q имеет вид (кривая 1 на рис. 20)ℰ(Q) =  при количестве уровней многоуровневой телеграфии (кривая 2 на рис. 20) N 0 =

при количестве уровней многоуровневой телеграфии (кривая 2 на рис. 20) N 0 =  ;

;

б ) если избыточность источника ДИС не снята, то при N >> 1 можно так закодировать дискретные сообщения соответствующими уровнями преобразователя ЦАП, что при Q > 8 справедливой оказывается оценка, вычисляемая с помощью формулы Шеннона для статического канала КПДС (кривая 3 на рис. 20, совпадающая с кривой 1 на рис. 23) ℰШ(Q) =  ;

;

в) при Q < 3 асимптотическая оценка величины ℰШ(Q) по статической формуле Шеннона не справедлива, эквивалентное количество уровней  становится менее двух (кривая 3 на рис. 23).

становится менее двух (кривая 3 на рис. 23).

Если же мы хотим передавать цифробуквенную информацию уровнями напряжения U (или тока I ) при наличии в канале КПДС гауссовских помех и при ограничении среднеквадратического уровня напряжения (или тока) в статическом канале КПДС, то мы должны поступить следующим образом.

1. Путём соответствующего кодирования знаков алфавита U = { uj }  символами W = { wk }

символами W = { wk }  (K < N ) снять избыточность источника ДИС.

(K < N ) снять избыточность источника ДИС.

2. В соответствии с коэффициентом информационной надёжности χ(Q)

статического канала КПДС провести достаточно надёжное помехоустойчивое кодирование сообщений и объединить сообщения в отдельные блоки.

3. Перекодировать информационные блоки так, чтобы получить квазигауссовское распределение их вероятностей.

4. Расположить получившиеся сообщения S = { Sm }  (M >> 1) по убывающим значениям их априорных вероятностей { Pm }

(M >> 1) по убывающим значениям их априорных вероятностей { Pm }  .

.

5. Определить энтропию (удельную информативность) источника ДИС  .

.

6. Составить уравнение для дисперсии уровней канала КПДС:

.

.

7. Решить уравнение log (1 + Ds / Dn) = 2 H (S) и тем самым определить оптимальную величину кванта Δ u 0:

Δ u 0 ≈  .

.

8. Каждому поступающему сообщению Sm из множества S =  приписывать значение уровня Um = m Δ u 0.

приписывать значение уровня Um = m Δ u 0.

Таким образом, мы рассмотрели основные проблемы информационной статики. На основании решения этих проблем (в «статическом режиме работы» систем электросвязи) перейдём к рассмотрению «динамических режимов работы» реальных систем электросвязи, то есть функционирование таких систем в режиме реального времени.

Вопросы для самопроверки

1. Каким образом приближённо вычисляется количество информации на выходе канала электросвязи при произвольном распределении сигналов и произвольных аддитивных помехах в канале электросвязи?

2. Каким образом выводится центральная формула Шеннона информационной статики?

3. Для каких каналов электросвязи и в каких пределах изменения величины отношения сигнал/шум справедлива центральная формула Шеннона информационной статики?

2015-06-04

2015-06-04 553

553