знаходження екстремальних значень ФУНКЦІЇ градієнтними методами (4 год.)

1 МЕТА РОБОТИ

1 Вивчення основних визначень і положень одномірної мінімізації.

2 Вивчення основних методів чисельного розв’язку задач одномірної мінімізації.

3 Розроблення і розв’язок на ЕОМ задачі мінімізації функцій багатьох змінних.

2 КОРОТКІ ТЕОРЕТИЧНІ ВІДОМОСТІ

В основі градієнтних методів лежать необхідні і достатні умови існування мінімуму функції  багатьох змінних.

багатьох змінних.

Нехай необхідно розв’язати задачу

(7.1)

(7.1)

Необхідними умовами того, що  - точка локального мінімуму є:

- точка локального мінімуму є:

1) функція  має часткові похідні у точці

має часткові похідні у точці  ;

;

2) градієнт функції  у точці

у точці  є нульовим вектором.

є нульовим вектором.

Достатніми умовами існування розв’язку задачі є вимога додатної визначеності матриці Гессе

.

.

Визначення. Будь-яка квадратна матриця додатньо визначена, якщо всі її діагональні визначники більші нуля.

Коли обчислення похідних функції  не становить принципових труднощів, то рекомендуються градієнтні методи мінімізації функції

не становить принципових труднощів, то рекомендуються градієнтні методи мінімізації функції  , які порівняно з методами прямого пошуку мають вищу швидкість збіжності. Існує велика кількість методів мінімізації, в яких для пошуку напрямку руху до мінімуму функції

, які порівняно з методами прямого пошуку мають вищу швидкість збіжності. Існує велика кількість методів мінімізації, в яких для пошуку напрямку руху до мінімуму функції  використовують градієнт

використовують градієнт  .

.

Узагальнена схема розв’язування задачі мінімізації градієнтним методом.

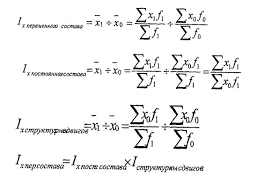

В усіх градієнтних методах будується ітераційний процес так, що в напрямку градієнта функції  критерій оптимальності зменшує своє значення при переході від k до k+1 ітерації. Методи, які задовольняють ці умови називаються методами спуску. Усі ці методи мають узагальнюючу схему.

критерій оптимальності зменшує своє значення при переході від k до k+1 ітерації. Методи, які задовольняють ці умови називаються методами спуску. Усі ці методи мають узагальнюючу схему.

Sp.1. Вибрати початкову (стартову) точку  .

.

Sp.2. Перевірити умови зупинок, і якщо вони виконуються, обчислення припинити і прийняти  як розв’язок задачі, в іншому ж випадку перейти до наступного кроку.

як розв’язок задачі, в іншому ж випадку перейти до наступного кроку.

Sp.3. Розрахувати нульовий n-мірний вектор  , названий напрямком пошуку.

, названий напрямком пошуку.

Sp.4. Вирахувати додатне число  (довжину кроку), яке забезпечить виконання нерівності

(довжину кроку), яке забезпечить виконання нерівності  .

.

Sp.5. Замінити  на

на  і k+1 на k і перейти до кроку 2.

і k+1 на k і перейти до кроку 2.

2015-07-14

2015-07-14 313

313