Классификация мер.

Для измерения информации вводятся два параметра: количество информации I и объем данных VД. Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности. Каждой форме адекватности соответствует своя мера количества информации и объема данных. Объем данных VД в сообщении измеряется количеством символов (разрядов) в этом сообщении. В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных: в двоичной системе счисления единица измерения - бит (bit - binаry digit - двоичный разряд); в десятичной системе счисления единица измерения - дит (десятичный разряд).

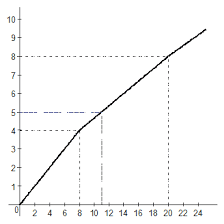

Количество информации I на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы). Действительно, получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе a. Мерой его неосведомленности о системе является функция H(a), которая в то же время служит и мерой неопределенности состояния системы.

Поэтому стремятся к повышению информативности, для чего разрабатываются специальные методы оптимального кодирования информации.

Возникновение информологии как науки можно отнести к концу 50-х годов нашего столетия, когда американским инженером Р. Хартли была сделана попытка ввести количественную меру информации, передаваемой по каналам связи. Рассмотрим простую игровую ситуацию. До получения сообщения о результате подбрасывания монеты человек находится в состоянии неопределенности относительно исхода очередного броска. Сообщение партнера дает информацию, снимающее эту неопределенность. Заметим, что число возможных исходов в описанной ситуации равно 2, они равноправны (равновероятны) и каждый раз передаваемая информация полностью снимала возникавшую неопределенность. Хартли принял «количество информации», передаваемое по каналу связи относительно двух равноправных исходов и снимающее неопределенность путем оказания на один из них, за единицу информации, получившую название «бит».

Создатель статистической теории информации К. Шеннон обобщил результат Хартли и его предшественников. Его труды явились ответом на бурное развитие в середине века средств связи: радио, телефона, телеграфа, телевидения. Теория информации Шеннона позволяла ставить и решать задачи об оптимальном кодировании передаваемых сигналов с целью повышения пропускной способности каналов связи, подсказывала пути борьбы с помехами на линиях и т.д.

В работах Хартли и Шеннона информация возникает перед нами лишь в своей внешней оболочке, которая представлена отношениями сигналов, знаков, сообщений друг к другу - синтаксическими отношениями. Количественная мера Хартли-Шеннона не претендует на оценку содержательной (семантической) или ценностной, полезной (прагматической) сторон передаваемого сообщения

Эта мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

2014-01-24

2014-01-24 741

741