Реальные каналы характеризуются тем, что на сигналы всегда воздействуют помехи.

Для каналов с помехами Шеннон дал вторую теорему.

В терминах энтропии эта теорема формулируется так.

Вторая теорема Шеннона.

Пусть имеется источник информации X, энтропия которого в единицу времени равна H(X), и канал с пропускной способностью C. Если H(X)>C, то при любом кодировании передача сообщений без задержек и искажений невозможна. Если же H(X)<C, то любое достаточно длинное сообщение можно всегда закодировать так, что оно будет передано без задержек и искажений с вероятностью сколь угодно близкой к единице.

Здесь особенность в том, что при наличии помехи пропускная способность уменьшается.

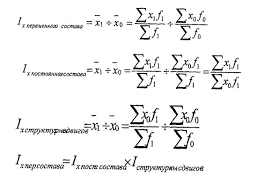

Пропускная способность дискретного канала с помехами вычисляется по формуле (2.4) С =n[Н(X) – Н(X/Y)]max,

где средняя условная энтропия со стороны приемника сигналов

| (4.1) |

А энтропия принимаемых сигналов определяется из условия максимального значения Н(X)=log N.

Пример 1. Пусть требуется определить пропускную способность бинарного канала связи. При этом с вероятностью р каждый из двоичных сигналов может перейти в противоположный сигнал.

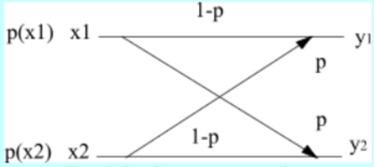

Рис.4.1. Симметричный канал передачи сигналов в условиях помех, где х1 и x2 передаваемые сигналы типа "0" или1", у1 иу2, принимаемые сигналы.

На рис.4.1. представлена модель передачи бинарных сигналов

1– р вероятность неискаженной передачи сигналов, р вероятность искажения сигналов.

Матрица условных вероятностей

Очевидно, что априорная вероятность P(yi) = P(xi).

Тогда выражение (4.1) для H(X/Y) примет вид

Поскольку  как полная группа несовместных событий, то

как полная группа несовместных событий, то

H(X) находим как

Тогда

| (4.2) |

График функции С (p)имеет следующий вид:

Рис. 4.2 График функции С(p).

Наибольшее значение эта функция принимаетпри р=0 (то есть при отсутствии помех)и при р=1 (то есть при негативной передаче).При р=1/2 пропускная способность минимальнаи равна нулю!!!.

На рис. 4.3 представлена модель передачи m-ичных сигналов, где x1,х2,…,хm источники информации, y1,y2,…,ym приемники информации.

Рассчитать для m =2, 3, 4.

профессор кафедры № 301

В. КНЯЗЕВ

2018-02-14

2018-02-14 563

563