- Как определяется дифференциальная энтропия непрерывной случайной величины? Разновидности энтропии непрерывной случайной величины.

- Чему равна максимальная дифференциальная энтропия, если случайная величина ограничена в объёме, при каком законе распределения она максимальна?

- Чему равна максимальная дифференциальная энтропия, если случайная величина не ограничена в объёме?

- Как влияет математическое ожидание случайной величины на её энтропию?

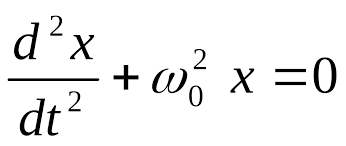

Дифференциальная энтропия — средняя информация непрерывного источника. Определяется как

бит

бит

где  — плотность распределения сигнала непрерывного источника как случайной величины.

— плотность распределения сигнала непрерывного источника как случайной величины.

Условная дифференциальная энтропия для величины  при заданной величине

при заданной величине  определяется следующей формулой:

определяется следующей формулой:

бит

бит

Безусловная и условная дифференциальные энтропии могут быть как положительными, так и отрицательными величинами, а также могут быть равны бесконечности.

Для дифференциальной энтропии справедливы равенства, аналогичные для энтропии дискретного источника:

(для независимых источников — равенство)

(для независимых источников — равенство)

Дифференциальная энтропия распределений с определенной фиксированной дисперсией  максимальна в случае гауссова распределения плотности вероятности сигнала непрерывного источника как случайной величины и равна

максимальна в случае гауссова распределения плотности вероятности сигнала непрерывного источника как случайной величины и равна

бит

бит

Для равномерного распределения:

бит

бит

Для распределения Лапласа

бит

бит

Литература

- Вернер М. 8.1 Дифференциальная энтропия // Основы кодирования = Information und Codierung / пер. Д.К. Зигангирова. — ЗАО «РИЦ „Техносфера“», 2004. — С. 109—114. — (Мир программирования). — 3 000 экз. —

| Глава 13. Энтропия и производительность эргодического источника непрерывного сигнала | назад | оглавление | вперёд |

Сигнал, отображающий непрерывное сообщение, можно рассматривать как некоторый эргодический случайный процесс, спектр которого ограничен полосой частот. В соответствии с теоремой Котельникова для описания этого процесса длительностью T требуется  отсчётов, где

отсчётов, где  – интервал Котельникова. Так как сигнал с ограниченным спектром полностью характеризуется своими отсчётными значениями, то знание значений сигнала между отсчётами не увеличивают наших знаний о сигнале. Следовательно, при определении энтропии непрерывного сигнала достаточно учитывать только его отсчётные значения.

– интервал Котельникова. Так как сигнал с ограниченным спектром полностью характеризуется своими отсчётными значениями, то знание значений сигнала между отсчётами не увеличивают наших знаний о сигнале. Следовательно, при определении энтропии непрерывного сигнала достаточно учитывать только его отсчётные значения.

Известно, что энтропия обладает свойством аддитивности. Так, если у какого‑то дискретного сигнала длительностью t энтропия равна H(x), то энтропия сигнала, составленного из N элементов, будет равна N×H(x). Аналогичным образом можно вычислить энтропию непрерывного сигнала длительностью T, которая будет равна

,

,

где H 1 (x) – энтропия одного сечения случайного сигнала, определяемая по формуле (28) через одномерную плотность вероятности. Размерность энтропии H 1 (x) – бит на один отсчёт случайного сигнала (одно сечение случайного процесса).

Производительность непрерывного случайного процесса будет равна

или

бит/с. (36)

бит/с. (36)

Таким образом, производительность эргодического источника непрерывного сигнала полностью определяется энтропией одного отсчета и удвоенной полосой частот этого сигнала.

2015-07-04

2015-07-04 817

817