Модель множественной регрессии

Естественным обобщением линейной регрессионной модели с двумя переменными является многомерная регрессионная модель, или модель множественной регрессии:

Yt = b1 + b2 xt2 +…+ bkxtk + et, t = 1,2,…,n,

или (43)

Yt = b1xt1 + b2xt2 +…+ bkxtk + et, t = 1,2,…,n,

где Xtp – значения регрессора Xp в наблюдении t, а через X1 обозначен вектор, состоящий из одних единиц (1, …, 1). С учетом этого в дальнейшем мы не будем различать модели вида (43) со свободным членом или без него.

Гипотезы, лежащие в основе модели множественной регрессии, являются естественным обобщением модели парной регрессии:

1. Yt=b1xt1+b2xt2+…+bkxtk+et, t=1,2,…,n – спецификация модели.

2. Xt1, ……,Xtk – детерминированные величины. Векторы

X1,……..,Xk – линейно независимы в Rn.

3а. Eet = 0, E (et2) = V (et) = s2 – не зависит от t.

3б. E (et es) = 0 при t ¹ s - статистическая независимость (некоррелированность) ошибок для разных наблюдений.

3в. et ~ N (0, s2), т.е. et – нормально распределенная случайная величина со средним 0 и дисперсией s2.

В этом случае модель называется нормальной линейной регрессионной.

Гипотезы, лежащие в основе множественной регрессии, удобно записать в матричной форме, которая главным образом и будет использоваться в дальнейшем.

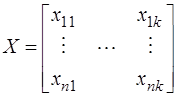

Обозначим через Y nх1 – вектор-столбец (y1,…,yn); b=(b1,…,bk), – kх1 – вектор коэффициентов; e=(e1,…,en)` – nх1 – вектор ошибок;

– nхk – матрица объясняющих переменных.

– nхk – матрица объясняющих переменных.

Столбцами матрицы X являются nх1 векторы регрессоров Xs=(X1s,…,Xns)`, s = 1,2,…,k. Условия 1-3 в матричной записи выглядят следующим образом:

1. Y = xb + e – спецификация модели.

2. X – детерминированная матрица, имеющая максимальный ранг k.

3а,б. E(e) = 0; V(e) = E(ee`) = s2In,

3в. e ~ N (0,s2In), т.е. e – нормально распределенный случайный вектор со средним 0 и матрицей ковариаций s2In (нормальная линейная регрессионная модель).

2014-02-24

2014-02-24 1463

1463