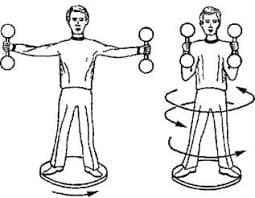

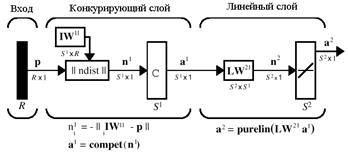

Архитектура LVQ-сети, предназначенной для классификации входных векторов,

показана на рис. 7.17.

Рис. 7.17

Рис. 7.17

LVQ-cеть имеет 2 слоя: конкурирующий и линейный. Конкурирующий слой выполняет кластеризацию векторов, а линейный слой соотносит кластеры с целевыми классами, заданными пользователем.

Как в конкурирующем, так и в линейном слое приходится 1 нейрон на кластер или целевой класс. Таким образом, конкурирующий слой способен поддержать до S 1 кластеров; эти кластеры, в свою очередь, могут быть соотнесены с S 2 целевыми классами, причем S 2 не превышает S 1. Например, предположим, что нейроны 1–3 конкурирующего слоя определяют 3 кластера, которые принадлежат к одному целевому классу #2 линейного слоя. Тогда выходы конкурирующих нейронов 1–3 будут передаваться в линейный слой на нейрон n 2 с весами, равными 1, а на остальные нейроны с весами, равными 0. Таким образом, нейрон n 2 возвращает 1, если любой

из трех нейронов 1–3 конкурирующего слоя выигрывает конкуренцию.

Короче говоря, единичный элемент в i- й строке вектора a 1 (остальные элементы a 1 нулевые) однозначно выберет i- й столбец матрицы весов LW 21 в качестве выхода сети. При этом каждый столбец, в свою очередь, содержит единственный элемент, равный 1, который указывает принадлежность к классу. Таким образом, кластер с номером 1 из слоя 1 может оказаться отнесенным к различным классам в зависимости от значения произведения LW 21 a 1.

Поскольку заранее известно, как кластеры первого слоя соотносятся с целевыми

классами второго слоя, то это позволяет заранее задать элементы матрицы весов LW 21. Однако чтобы найти правильный кластер для каждого вектора обучающего множества, необходимо выполнить процедуру обучения сети.

2015-08-21

2015-08-21 411

411