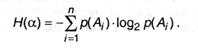

За меру неопределенности опыта с n исходами А 1, А 2 ... Ап принимается число H:

Это и есть знаменитая формула К.Шеннона

Это и есть знаменитая формула К.Шеннона

Исходы опытов неравновероятны и равны р(Аi).

Энтропия является мерой неопределенности опыта, в котором проявляются случайные события, и равна средней неопределенности всех возможных его исходов.

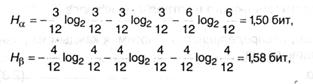

Пример 2.1

Имеются два ящика, в каждом из которых по 12 шаров. В первом -3 белых, 3 черных и 6 красных; во втором - каждого цвета по 4. Опыты состоят в вытаскивании по одному шару из каждого ящика. Что можно сказать относительно неопределенностей исходов этих опытов?

Согласно (2.4) находим энтропии обоих опытов:

Н β > Н α, т.е. неопределенность результата в опыте β выше и, следовательно, предсказать его можно с меньшей долей уверенности, чем результат α.

2015-03-22

2015-03-22 621

621