Для устранения мультиколлинеарности существует несколько подходов:

1. Исключение связанных между собой независимых факторов путем отбора мало существенных из них. Для этого необходимо исполнить следующие процедуры:

1) Включение дополнительных факторов

2) Исключение факторов

3) Пошаговая регрессия

При исключении факторов придерживаются следующих принципов (рассматривают только факторы, между которыми доказана мультиколлинеарность):

1) исходя из теоретических предположений о наименьшей информативности факторов

2) убирают самый наименее значимый фактор из мультиколлинеарных на основе t-статистики (t-статистика должна быть наименьшей)

2. Переход к ортогональным переменным с помощью метода главных компонентов.

В данном методе заменяют сильно коррелированные переменные совокупностью новых, между которыми корреляция отсутствует. Но эти переменные являются линейными комбинациями исходных переменных.

3. Подход, учитывающий мультиколлинеарность – метод гребневой регрессии.

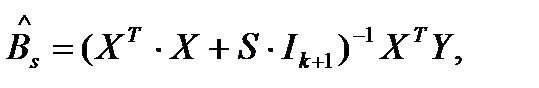

В методе гребневой регрессии строятся несколько измененные коэффициенты регрессии МНК.

где

где

)-1 – обратная матрица

k – количество факторов

Ik+1 – матрица размерности n*m, приведенная к верхнетреугольному виду.

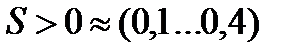

Добавление к диагональным элементам числа S позволяет получить невырожденную матрицу XTX и вместе с тем, оценки Bx будут иметь незначительные смещения. Но это можно компенсировать за счет правильного выбора S (т.е. средне квадратичные ошибки в методе гребневой регрессии будут меньше, чем аналогичные ошибки в МНК-оценках).

Для устранения или уменьшения мультиколлинеарности используется ряд методов.

Наиболее распространенные в таких случаях следующие приемы: исключение одного из двух сильно связанных факторов, переход от первоначальных факторов к их главным компонентам, число которых быть может меньше, затем возвращение к первоначальным факторам.

Самый простой из них состоит в том, что из двух объясняющих переменных, имеющих высокий коэффициент корреляции (больше 0,8), одну переменную исключают из рассмотрения. При этом какую переменную оставить, а какую удалить из анализа, решают в первую очередь на основании экономических соображений. Если с экономической точки зрения ни одной из переменных нельзя отдать предпочтение, то оставляют ту из двух переменных, которая имеет больший коэффициент корреляции с зависимой переменной.

Еще одним из возможных методов устранения или уменьшения мультиколлинеарности является использование стратегии шагового отбора.

Наиболее широкое применение получили следующие схемы построения уравнения множественной регрессии: метод включения факторов и метод исключения – отсев факторов из полного его набора. В соответствии с первой схемой признак включается в уравнение в том случае, если его включение существенно увеличивает значение множественного коэффициента корреляции, что позволяет последовательно отбирать факторы, оказывающие существенное влияние на результирующий признак даже в условиях мультиколлинеарности системы признаков, отобранных в качестве аргументов из содержательных соображений. При этом первым в уравнение включается фактор, наиболее тесно коррелирующий с Y, вторым в уравнение включается тот фактор, который в паре с первым из отобранных дает максимальное значение множественного коэффициента корреляции, и т.д.

Вторая схема заключается в том, что после построения уравнения регрессии и оценки значимости всех коэффициентов регрессии из модели исключают тот фактор, коэффициент при котором незначим и имеет наименьший коэффициент t. После этого получают новое уравнение множественной регрессии и снова производят оценку значимости всех оставшихся коэффициентов регрессии. Процесс исключения факторов останавливается на том шаге, при котором все регрессионные коэффициенты значимы.

Особым случаем мультиколлинеарности при использовании временных выборок является наличие в составе переменных линейных или нелинейных трендов. В этом случае рекомендуется сначала выделить и исключить тренды, а затем определить параметры регрессии по остаткам. Игнорирование наличия трендов в зависимой и независимой переменных ведет к завышению степени влияния независимых переменных на результирующий признак, что получило название ложной корреляции.

2015-05-18

2015-05-18 672

672