Информация — значимые сведения о чём-либо, когда форма их представления также является информацией, то есть имеет форматирующую функцию в соответствии с собственной природой.

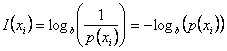

Предметом изучения науки информатика являются именно данные: методы их создания, хранения, обработки и передачи[3]. А сама информация, зафиксированная в данных, её содержательный смысл интересны пользователям информационных систем, являющимся специалистами различных наук и областей деятельности: медика интересует медицинская информация, геолога — геологическая, предпринимателя — коммерческая и тп. (в том числе специалиста по информатике интересует информация по вопросам работы с данными).Количество информации  в отдельно взятом единичном сообщении

в отдельно взятом единичном сообщении  определяется величиной, обратной вероятности появления сообщения

определяется величиной, обратной вероятности появления сообщения  и вычисляется в логарифмических единицах [2]:

и вычисляется в логарифмических единицах [2]:

. .

| (4.1) |

Логарифмическая мера, впервые предложенная в 1928 г. английским ученым Р. Хартли, обладает свойством аддитивности, что соответствует нашим интуитивным представлениям об информации. Кроме того, при  количество информации, вычисленное по (4.1), равно нулю, что соответствует принятому определению информации. Если источник выдает зависимые сообщения

количество информации, вычисленное по (4.1), равно нулю, что соответствует принятому определению информации. Если источник выдает зависимые сообщения  , то они характеризуются условными вероятностями

, то они характеризуются условными вероятностями  . И в этом случае количество информации вычисляется по формуле (4.1) с подстановкой в нее условных вероятностей сообщений.

. И в этом случае количество информации вычисляется по формуле (4.1) с подстановкой в нее условных вероятностей сообщений.

2018-01-21

2018-01-21 1013

1013