В практических задачах синтеза в условиях априорной неопределенности часто характерно наличие большого объема данных наблюдения х, которые могут включать в себя (см. гл. 3) информацию о прошлом опыте, данные обучения, эмпирическую статистику и т. д. При этом в случае полного статистического описания значительная часть этих данных оказалась бы избыточной, зато в условиях априорной неопределенности такая избыточность является в какой-то степени компенсацией за отсутствие четкого и полного статистического описания задачи. Поясним это на примере простой задачи двухальтернативного решения ( или

или  ,

,  или

или  ,

,  ,

,  ) на основании данных наблюдения

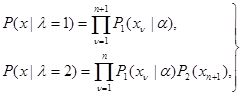

) на основании данных наблюдения  , образующих совокупность независимо распределенных величин. Пусть

, образующих совокупность независимо распределенных величин. Пусть

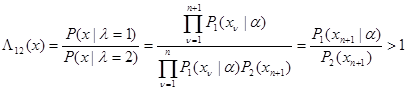

(4.3.3)

(4.3.3)

где  - некоторый параметр плотности вероятности

- некоторый параметр плотности вероятности . Статистическое описание (4.3.3) соответствует, например, случаю, когда фактически решение должно быть принято на (n+ 1)-м шаге по результатам наблюдения

. Статистическое описание (4.3.3) соответствует, например, случаю, когда фактически решение должно быть принято на (n+ 1)-м шаге по результатам наблюдения  , а предыдущая серия {

, а предыдущая серия { }наблюдалась в условиях точно известной ситуации (

}наблюдалась в условиях точно известной ситуации ( ) и может рассматриваться в качестве обучающей последовательности. Возможная априорная неопределенность в данной задаче связана с незнанием параметра

) и может рассматриваться в качестве обучающей последовательности. Возможная априорная неопределенность в данной задаче связана с незнанием параметра  , из-за чего статистическое описание (4.3.3) становится неполным.

, из-за чего статистическое описание (4.3.3) становится неполным.

Если априорная неопределенность отсутствует - параметр  известен - оптимальное правило решения имеет вид (гл. 2): принимается

известен - оптимальное правило решения имеет вид (гл. 2): принимается  , если

, если

. (4.3.4)

. (4.3.4)

Это правило, естественно, зависит только от  , а все остальные данные наблюдения являются избыточными. Если параметр

, а все остальные данные наблюдения являются избыточными. Если параметр  неизвестен, то знание {

неизвестен, то знание { }очень существенно, поскольку оно может быть использовано для уменьшения априорной неопределенности из-за неизвестности

}очень существенно, поскольку оно может быть использовано для уменьшения априорной неопределенности из-за неизвестности  .

.

При этом по крайней мере интуитивно ясно, что чем больше объем подобных «избыточных» данных (в рассматриваемом примере этот объем характеризуется числом наблюдений  ), тем меньше влияние априорной неопределенности. Поэтому можно надеяться, что при увеличении объема и улучшения качества наблюдаемых данных х можно получить решение такого же качества, как если бы априорная неопределенность отсутствовала и распределение

), тем меньше влияние априорной неопределенности. Поэтому можно надеяться, что при увеличении объема и улучшения качества наблюдаемых данных х можно получить решение такого же качества, как если бы априорная неопределенность отсутствовала и распределение  нам было бы известно точно. Отсюда

нам было бы известно точно. Отсюда

логически вытекает принцип асимптотической оптимальности, который может быть сформулирован следующим образом:

- более предпочтительным является такое правило решения  , для которого средний риск

, для которого средний риск  с увеличением объема данных наблюдения стремится к минимальному байесову риску

с увеличением объема данных наблюдения стремится к минимальному байесову риску

для всех

для всех P равномерно.

P равномерно.

Само правило решения  , удовлетворяющее этому требованию, является асимптотически равномерно наилучшим решением, а при ограниченном, но большом объеме данных наблюдения х - приближенно равномерно наилучшим. Принцип асимптотической оптимальности имеет очевидный недостаток - он не определяет

, удовлетворяющее этому требованию, является асимптотически равномерно наилучшим решением, а при ограниченном, но большом объеме данных наблюдения х - приближенно равномерно наилучшим. Принцип асимптотической оптимальности имеет очевидный недостаток - он не определяет  вполне однозначно и оставляет открытым вопрос, какое из асимптотически оптимальных правил решения лучше при ограниченном объеме данных наблюдения. Однако столь же очевидна и его полезность - он позволяет отклонить как неудовлетворительные те правила, которые даже асимптотически существенно отличаются от оптимального байесова.

вполне однозначно и оставляет открытым вопрос, какое из асимптотически оптимальных правил решения лучше при ограниченном объеме данных наблюдения. Однако столь же очевидна и его полезность - он позволяет отклонить как неудовлетворительные те правила, которые даже асимптотически существенно отличаются от оптимального байесова.

4.3.3. Минимаксиминный принцип (минимакс минимального среднего риска)

Рассмотрим теперь общий случай, когда минимум риска  по

по  достигается при разных значениях

достигается при разных значениях  для различных

для различных  P. Каждое из решений

P. Каждое из решений  является оптимальным байесовым решением для своего (неизвестного из-за наличия априорной неопределенности) значения

является оптимальным байесовым решением для своего (неизвестного из-за наличия априорной неопределенности) значения  , а их совокупность образует некоторое подмножество

, а их совокупность образует некоторое подмножество  байесовых решающих правил (на рис. 4.1. заштрихованный прямоугольник). При этом если мы возьмем какое-то из этих правил

байесовых решающих правил (на рис. 4.1. заштрихованный прямоугольник). При этом если мы возьмем какое-то из этих правил  , то оно обязательно соответствует некоторому

, то оно обязательно соответствует некоторому  P, обеспечивая минимум апостериорного и среднего риска для этого

P, обеспечивая минимум апостериорного и среднего риска для этого  и в то же время для других

и в то же время для других

при

при  .

.

Предположим, что мы хотим ограничить свой выбор только множеством  , то есть выбирать правила решения среди оптимальных байесовых для всевозможных, но каждый раз известных

, то есть выбирать правила решения среди оптимальных байесовых для всевозможных, но каждый раз известных  P. Фактически это означает устранение априорной неопределенности выбором какого-то заранее определенного значения

P. Фактически это означает устранение априорной неопределенности выбором какого-то заранее определенного значения  и синтезом системы для вполне определенных условий, соответствующих этому значению. Возникает вопрос, как выбрать значение

и синтезом системы для вполне определенных условий, соответствующих этому значению. Возникает вопрос, как выбрать значение  (и соответствующее ему решение

(и соответствующее ему решение  ). Естественный способ заключается в применении принципа минимакса к величине байесова риска. При этом значение

). Естественный способ заключается в применении принципа минимакса к величине байесова риска. При этом значение  выбирается из условия

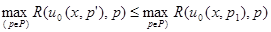

выбирается из условия

для всех

для всех  P. (4.3.5)

P. (4.3.5)

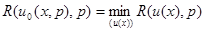

где  - оптимальное байесово правило решения, выбираемое из условия

- оптимальное байесово правило решения, выбираемое из условия  при данном

при данном  . Процедура выбора правила решения, удовлетворяющая рассматриваемому принципу, эквивалентна выбору

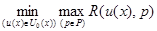

. Процедура выбора правила решения, удовлетворяющая рассматриваемому принципу, эквивалентна выбору  , обеспечивающего

, обеспечивающего

. (4.3.6)

. (4.3.6)

Рассматриваемый принцип достаточно прост, так как не требует разработки существенно новой методики выбора правила решения. Он целиком основывается на технике получения байесовых правил решения, поскольку ограничивает выбор только такими правилами для различных P и, конечно, автоматически приводит к равномерно наилучшему правилу решения, если оно существует. В то же время ясно, что именно указанное ограничение (выбор

P и, конечно, автоматически приводит к равномерно наилучшему правилу решения, если оно существует. В то же время ясно, что именно указанное ограничение (выбор  только из подмножества

только из подмножества  ) не гарантирует от того, что будет упущено какое-то лучшее в условиях априорной неопределенности правило решения. Подмножество

) не гарантирует от того, что будет упущено какое-то лучшее в условиях априорной неопределенности правило решения. Подмножество  , вообще говоря, не тождественно полному классу решающих правил, о котором шла речь в гл. 2, поскольку оно соответствует «условно» байесовым решениям, каждое из которых получается в предположении о полностью известной статистике. Полный класс решающих правил для рассматриваемой задачи с априорной неопределенностью получается, если взять множество всех

, вообще говоря, не тождественно полному классу решающих правил, о котором шла речь в гл. 2, поскольку оно соответствует «условно» байесовым решениям, каждое из которых получается в предположении о полностью известной статистике. Полный класс решающих правил для рассматриваемой задачи с априорной неопределенностью получается, если взять множество всех  , минимизирующих усредненный риск

, минимизирующих усредненный риск  из (4.3.2) для всевозможных нормированных на единицу мер

из (4.3.2) для всевозможных нормированных на единицу мер  , которые трактуются при этом как некоторые априорные распределения на множестве P, описывающем априорную неопределенность.

, которые трактуются при этом как некоторые априорные распределения на множестве P, описывающем априорную неопределенность.

Минимаксиминный принцип слабо использует или вообще игнорирует ту избыточность в данных наблюдения, которая может являться компенсацией за априорную неопределенность. (В примере п. 4.3.2 минимаксиминное правило будет иметь вид (4.3.4) при некотором  и не будет учитывать наличие наблюдений {

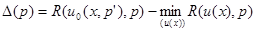

и не будет учитывать наличие наблюдений { }.) В то же время довольно легко оценить степень приближения решения, полученного на основе этого принципа, к абсолютно оптимальному (при отсутствии априорной неопределенности). Критерием близости может служить разность

}.) В то же время довольно легко оценить степень приближения решения, полученного на основе этого принципа, к абсолютно оптимальному (при отсутствии априорной неопределенности). Критерием близости может служить разность

. (4.3.7)

. (4.3.7)

Если при всех значениях  эта разность не превышает допустимо малой величины

эта разность не превышает допустимо малой величины  (вообще говоря, зависящей от

(вообще говоря, зависящей от  ), то правило решения

), то правило решения  является приближенным равномерно наилучшим правилом с уровнем приближения, не худшим чем

является приближенным равномерно наилучшим правилом с уровнем приближения, не худшим чем  . Таким образом, использование рассматриваемого принципа дает возможность выявить, существует или нет приближенное равномерно наилучшее правило решения, и получить его с помощью стандартной байесовой процедуры. Вообще говоря, ясно, что разность

. Таким образом, использование рассматриваемого принципа дает возможность выявить, существует или нет приближенное равномерно наилучшее правило решения, и получить его с помощью стандартной байесовой процедуры. Вообще говоря, ясно, что разность  из (4.3.7) может оказаться достаточно малой только в том случае, когда множество P содержит не слишком много элементов, отличающихся от некоторого истинного, но неизвестного значения

из (4.3.7) может оказаться достаточно малой только в том случае, когда множество P содержит не слишком много элементов, отличающихся от некоторого истинного, но неизвестного значения  . В противном случае, если, например, множество P неограничено, средний риск минимаксиминного правила решения может достигать величины максимального значения функции потерь, а при неограниченной функции потерь может также стать неограниченным. Таким образом, минимаксиминный принцип предпочтения действительно серьезно препятствует выбору плохих правил решения только тогда, когда априорная неопределенность относительно невелика. В общем же случае он позволяет выбирать и непригодные правила решения, поэтому ценность этого принципа предпочтения невелика.

. В противном случае, если, например, множество P неограничено, средний риск минимаксиминного правила решения может достигать величины максимального значения функции потерь, а при неограниченной функции потерь может также стать неограниченным. Таким образом, минимаксиминный принцип предпочтения действительно серьезно препятствует выбору плохих правил решения только тогда, когда априорная неопределенность относительно невелика. В общем же случае он позволяет выбирать и непригодные правила решения, поэтому ценность этого принципа предпочтения невелика.

2014-02-04

2014-02-04 602

602