Под полной мультиколлинеарностью понимается существование между некоторыми из факторов линейной функциональной связи. В практике статистических исследований полная мультиколлинеарность встречается достаточно редко, т.к. её несложно избежать уже на предварительной стадии анализа и отбора множества объясняющих переменных.

Реальная (или частичная) мультиколлинеарность возникает в случаях существования достаточно тесных линейных статистических связей между объясняющими переменными. Точных количественных критериев для определения наличия или отсутствия реальной мультиколлинеарности не существует.

Под мультиколлинеарностью понимается высокая взаимная коррелированность объясняющих переменных. Мультиколлинеарность может проявляться в функциональной (явной) и стохастической (скрытой) формах.

При функциональной форме мультиколлинеарности по крайней мере одна из парных связей между объясняющими переменными является линейной функциональной зависимостью. В этом случае матрица X`X особенная, так как содержит линейно зависимые векторы-столбцы, и её определитель равен нулю, т.е. нарушается предпосылка регрессионного анализа, это приводит к невозможности решения соответствующей системы нормальных уравнений и получения оценок параметров регрессионной модели.

Однако в экономических исследованиях мультиколлинеарность чаще проявляется в стохастической форме, когда между хотя бы двумя объясняющими переменными существует тесная корреляционная связь. Матрица X`X в этом случае является неособенной, но её определитель очень мал.

В то же время вектор оценок b и его ковариционная матрица ∑b пропорциональны обратной матрице (X`X)-1, а значит, их элементы обратно пропорциональны величине определителя |X`X|. В результате получаются значительные средние квадратические отклонения (стандартные ошибки) коэффициентов регрессии b0, b1,…,bp и оценка их значимости по t-критерию не имеет смысла, хотя в целом регрессионная модель может оказаться значимой по F-критерию.

Оценки становятся очень чувствительными к незначительному изменению результатов наблюдений и объёма выборки. Уравнения регрессии в этом случае, как правило, не имеют реального смысла, так как некоторые из его коэффициентов могут иметь неправильные с точки зрения экономической теории знаки и неоправданно большие значения.

Точных количественных критериев для определения наличия или отсутствия мультиколлинеарности не существует. Тем не менее, имеются некоторые эвристические подходы по её выявлению.

Один из таких подходов заключается в анализе корреляционной матрицы между объясняющими переменными X1,X2,…,Xp и выявлении пар переменных, имеющих высокие переменные корреляции (обычно больше 0,8). Если такие переменные существуют, говорят о мультиколлинеарности между ними. Полезно также находить множественные коэффициенты детерминации между одной из объясняющих переменных и некоторой группой из них. Наличие высокого множественного коэффициента детерминации (обычно больше 0,6) свидетельствует о мультиколлинеарности.

Другой подход состоит в исследовании матрицы X`X. Если определитель матрицы X`X либо её минимальное собственное значение λmin близки к нулю (например, одного порядка с накапливающимися ошибками вычислений), то это говорит о наличии мультиколлинеарности. О том же может свидетельствовать и значительное отклонение максимального собственного значения λmax матрицы X`X от её минимального собственного значения λmin.

Для устранения или уменьшения мультиколлинеарности используется ряд методов. Самый простой из них (но далеко не всегда возможный) состоит в том, что из двух объясняющих переменных, имеющих высокий коэффициент корреляции (больше 0,8), одну переменную исключают из рассмотрения. При этом, какую переменную оставить, а какую удалить из анализа, решают в первую очередь на основании экономических соображений. Если с экономической точки зрения ни одной из переменных нельзя отдать предпочтение, то оставляют ту из двух переменных, которая имеет больший коэффициент корреляции с зависимой переменной.

Другой метод устранения или уменьшения мультиколлинеарности заключается в переходе от несмещённых оценок, определённых по методу наименьших квадратов, к смещённым оценкам, обладающим, однако, меньшим рассеянием относительно оцениваемого параметра, т.е. меньшим математическим ожиданием квадрата отклонения оценки bj от параметра βj или M (bj- βj)2.

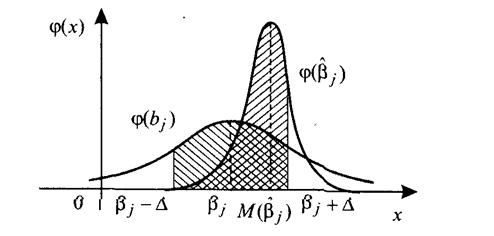

Оценки, определяемые вектором, обладают в соответствии с теоремой Гаусса-Маркова минимальными дисперсиями в классе всех линейных несмещённых оценок, но при наличии мультиколлинеарности эти дисперсии могут оказаться слишком большими, и обращение к соответствующим смещённым оценкам может повысить точность оценивания параметров регрессии. На рисунке показан случай, когда смещённая оценка βj^, выборочное распределение которой задаётся плотностью φ(βj^).

Действительно, пусть максимально допустимый по величине доверительный интервал для оцениваемого параметра βjесть (βj-Δ, βj+Δ). Тогда доверительная вероятность, или надёжность оценки, определяемая площадью под кривой распределения на интервале (βj-Δ, βj+Δ), как нетрудно видеть из рисунка, будет в данном случае больше для оценки βjпо сравнению с bj (на рисунке эти площади заштрихованы). Соответственно средний квадрат отклонения оценки от оцениваемого параметра будет меньше для смещённой оценки, т.е.:

M (βj^-βj)2 <M (bj - βj)2

При использовании «ридж-регрессии» (или «гребневой регрессии») вместо несмещённых оценок рассматривают смещённые оценки, задаваемые вектором

βτ^=(X`X+τEp+1)-1 X`Y,

где τ – некоторое положительное число, называемое «гребнем» или «хребтом»,

Ep+1 – единичная матрица (р+1) –го порядка.

Добавление τ к диагональным элементам матрицы X`X делает оценки параметров модели смещёнными, но при этом увеличивается определитель матрицы системы нормальных уравнений – вместо (X`X) от будет равен

|X`X+τ Ep+1|

Таким образом, становится возможным исключение мультиколлинеарности в случае, когда определитель |X`X| близок к нулю.

Для устранения мультиколлинеарности может быть использован переходот исходных объясняющих переменныхX1,X2,…,Xn, связанных между собой достаточно тесной корреляционной зависимостью, к новым переменным, представляющим линейные комбинации исходных. При этом новые переменные должны быть слабокоррелированными либо вообще некоррелированными. В качестве таких переменных берут, например, так называемые главные компоненты вектора исходных объясняющих переменных, изучаемые в компонентном анализе, и рассматривают регрессию на главных компонентах, в которой последние выступают в качестве обобщённых объясняющих переменных, подлежащих в дальнейшем содержательной (экономической) интерпретации.

Ортогональность главных компонент предотвращает проявление эффекта мультиколлинеарности. Кроме того, применяемый метод позволяет ограничиться малым числом главных компонент при сравнительно большом количестве исходных объясняющих переменных.

Мультиколлинеарность — это понятие, которое используется для описания проблемы, когда нестрогая линейная зависимость между объясняющими переменными приводит к получению ненадежных оценок регрессии. Разумеется, такая зависимость совсем необязательно дает неудовлетворительные оценки. Если все другие условия благоприятствуют, т. е. если число наблюдений и выборочные дисперсии объясняющих переменных велики, а дисперсия случайного члена мала, то в итоге можно получить вполне хорошие оценки.

Итак, мультиколлинеарность должна вызываться сочетанием нестрогой зависимости и одного (или более) неблагоприятного условия, и это — вопрос степени выраженности явления, а не его вида. Оценка любой регрессии будет страдать от нее в определенной степени, если только все независимые переменные не окажутся абсолютно некоррелированными. Рассмотрение данной проблемы начинается только тогда, когда это серьезно влияет на результаты оценки регрессии.

Эта проблема является обычной для регрессий временных рядов, т. е. когда данные состоят из ряда наблюдений в течение какого-то периода времени. Если две или более независимые переменные имеют ярко выраженный временной тренд, то они будут тесно коррелированы, и это может привести к мультиколлинеарности.

Перечислим основные последствия мультиколлинеарности:

1. Большие дисперсии оценок. Это затрудняет нахождение истинных значений определяемых величин и расширяет интервальные оценки, ухудшая их точность.

2. Уменьшаются t – статистики коэффициентов, что может привести к неоправданному выводу о несущественности влияния соответствующего фактора на зависимую переменную.

3. Оценки коэффициентов по МНК и их стандартные ошибки становятся очень чувствительными к малейшим изменениям данных, т.е. они становятся неустойчивыми.

4. Затрудняется определение вклада каждой из объясняющих переменных в объясняемую уравнением регрессии дисперсию зависимой переменной.

5. Возможно получение неверного знака у коэффициента регрессии.

Единого подхода к устранению мультиколлинеарности не существует. Существует ряд методов, которые не являются универсальными и применимы в конкретных ситуациях.

Простейшим методом устранения мультиколлинеарности является исключение из модели одной или нескольких коррелированных переменных. Здесь необходима осторожность, чтобы не отбросить переменную, которая необходима в модели по своей экономической сущности, но зачастую коррелирует с другими переменными (например, цена блага и цены заменителей данного блага).

Иногда для устранения мультиколлинеарности достаточно увеличить объем выборки. Например, при использовании ежегодных данных можно перейти к поквартальным данным. Это приведёт к сокращению дисперсии коэффициентов регрессии и увеличению их статистической значимости. Однако при этом можно усилить автокорреляцию, что ограничивает возможности такого подхода.

В некоторых случаях изменение спецификации модели, например, добавление существенного фактора, решает проблему мультиколлинеарности. При этом уменьшается остаточная СКО, что приводит к уменьшению стандартных ошибок коэффициентов.

В ряде случаев минимизировать либо вообще устранить проблему мультиколлинеарности можно с помощью преобразования переменных.

Теперь рассмотрим другой вопрос, имеющий важное значение для проблем, связанных со спецификацией модели множественной регрессии. Это частная корреляция. С помощью частных коэффициентов корреляции проводится ранжирование факторов по степени их влияния на результат. Кроме того, частные показатели корреляции широко используются при решении проблем отбора факторов: целесообразность включения того или иного фактора в модель доказывается величиной показателя частной корреляции.

Частные коэффициенты корреляции характеризуют тесноту связи между результатом и соответствующим фактором при устранении влияния других факторов, включенных в уравнение регрессии.

Показатели частной корреляции представляют собой отношение сокращения остаточной дисперсии за счет дополнительного включения в модель нового фактора к остаточной дисперсии, имевшей место до введения его в модель.

Высокое значение коэффициента парной корреляции между исследуемой зависимой и какой – либо независимой переменной может означать высокую степень взаимосвязи, но может быть обусловлено и другой причиной, например, третьей переменной, которая оказывает сильное влияние на две первые, что и объясняет их высокую коррелированность. Поэтому возникает задача найти «чистую» корреляцию между двумя переменными, исключив (линейное) влияние других факторов. Это можно сделать с помощью коэффициента частной корреляции.

Коэффициенты частной корреляции определяются различными способами.

Теперь остановимся на специальных процедурах спецификации модели множественной регрессии, которые обычно называются процедурами пошагового отбора переменных.

Иногда исследователь заранее знает характер зависимости исследуемых величин, опираясь на экономическую теорию, предыдущие результаты или априорные знания, и его задача состоит лишь в оценивании неизвестных параметров. Классическим примером является оценивание параметров производственной функции Кобба – Дугласа, где заранее известно, что в качестве факторов выступают капиталовложения и трудозатраты.

Однако на практике чаще имеется большое число наблюдений различных независимых переменных, но нет априорной модели изучаемого явления. Возникает проблема, какие переменные включать в регрессионную схему.

В компьютерные пакеты включены различные эвристрические процедуры пошагового отбора факторов. Основными пошаговыми процедурами являются:

- процедура последовательного присоединения;

- процедура последовательного присоединения – удаления;

- процедура последовательного удаления.

Следует признать, что пошаговые процедуры, не гарантируют получения оптимального (в смысле критерия максимума коэффициента детерминации) набора факторов. Однако в подавляющем большинстве ситуаций получаемые с помощью пошаговой процедуры наборы переменных оказываются оптимальными или близкими к оптимальным.

2015-01-30

2015-01-30 7290

7290