Р.Х. Садыхов, М.М. Лукашевич

по дисциплинам «Цифровая обработка сигналов и изображений»

и «Методы и средства обработки изображений» для студентов

специальностей I-40 02 01 «Вычислительные машины, системы и сети»

и I-40 01 01 «Программное обеспечение информационных технологий»

В 2-х частях

Часть 2

Минск 2006

УДК 004 (075.8)

ББК 32.973 я 73

С 14

Садыхов Р.Х.

| С 14 | Лабораторный практикум по дисципл. «Цифровая обработка сигналов и изображений» и «Методы и средства обработки изображений» для студ. спец. I-40 02 01 «Вычислительные машины, системы и сети» и I-40 01 01 «Программное обеспечение информационных технологий»: В 2 ч. Ч. 2 /Р.Х. Садыхов, М.М. Лукашевич. – Мн.: БГУИР, 2006. – 32 c. ISBN 985-488-068-0 (ч. 2) |

| 2-я часть лабораторного практикума содержит перечень лабораторных работ по дисциплинам «Цифровая обработка сигналов и изображений» и «Методы и средства обработки изображений», читаемым студентам специальности «Вычислительные машины, системы и сети» и «Программное обеспечение информационных технологий» и является логическим продолжением 1-й части. 2-я часть практикума посвящена изучению методов обработки данных с применением нейронных сетей. Рассматриваются особенности нейронных сетей различных типов, архитектур, структур и алгоритмов. Показана возможность применения нейронных сетей для решения задач обработки данных, распознавания образов, классификации и др. |

УДК 004 (075.8)

ББК 32.973 я 73

Первая часть издана в БГУИР в 2006 г.

| ISBN 985-488-068-0 (ч. 2) | © Садыхов Р.Х., Лукашевич М.М., 2006 |

| ISBN 985-444-979-3 | © БГУИР, 2006 |

Содержание

| Введение………………………..………………………………………….4 1. Лабораторная работа №1. Нейронная сеть Хопфилда…………….10 2. Лабораторная работа №2. Многослойный персептрон……………15 3. Лабораторная работа №3. Сеть РБФ………………………………..23 4. Лабораторная работа №4. Конкурентная нейронная сеть………...27 Литература……………………………………………………………….31 |

Введение

Приведем одно из определений искусственных нейронных сетей [1]:

Искусственная нейронная сеть (ИНС) – это существенно параллельно распределенный процессор, который обладает способностью к сохранению и репрезентации опытного знания. Она сходна с мозгом в двух аспектах:

· знание приобретается сетью в процессе обучения;

· для сохранения знания используются силы межнейронных соединений, называемые также синаптическими соединениями.

Работа нейронной сети (НС) состоит в преобразовании входных сигналов во времени, в результате чего меняется внутреннее состояние сети и формируются выходные воздействия. Обычно НС оперирует цифровыми, а не символьными величинами. Большинство моделей НС требуют обучения. В общем случае обучение — этотакой выбор параметров сети, при котором сеть лучше всего справляется с поставленной проблемой. Обучение — это задача многомерной оптимизации, и для ее решения существует множество алгоритмов.

Современные искусственные НС демонстрируют следующие ценные свойства:

1. Обучаемость. Выбрав одну из моделей НС, создав сеть и выполнив алгоритм обучения, мы можем обучить сеть решению задачи, которая ей по силам.

2. Способность к обобщению. После обучения сеть становится нечувствительной к малым изменениям входных сигналов (шуму или вариациям входных образов) и дает правильный результат на выходе.

3. Способность к абстрагированию. Если предъявить сети несколько искаженных вариантов входного образа, то сеть сама может создать на выходе идеальный образ, с которым она никогда не встречалась.

К задачам, успешно решаемым НС на данном этапе их развития, относятся:

· распознавание зрительных, слуховых образов;

· ассоциативный поиск информации и создание ассоциативных моделей, синтез речи, формирование естественного языка;

· формирование моделей и различных нелинейных и трудноописываемых математически систем, прогнозирование развития этих систем во времени;

· системы управления и регулирования с предсказанием;

· разнообразные конечные автоматы: системы массового обслуживания и коммутации, телекоммуникационные системы;

· принятие решений и диагностика, исключающие логический вывод, особенно в областях, где отсутствуют четкие математические модели: в медицине, криминалистике, финансовой сфере.

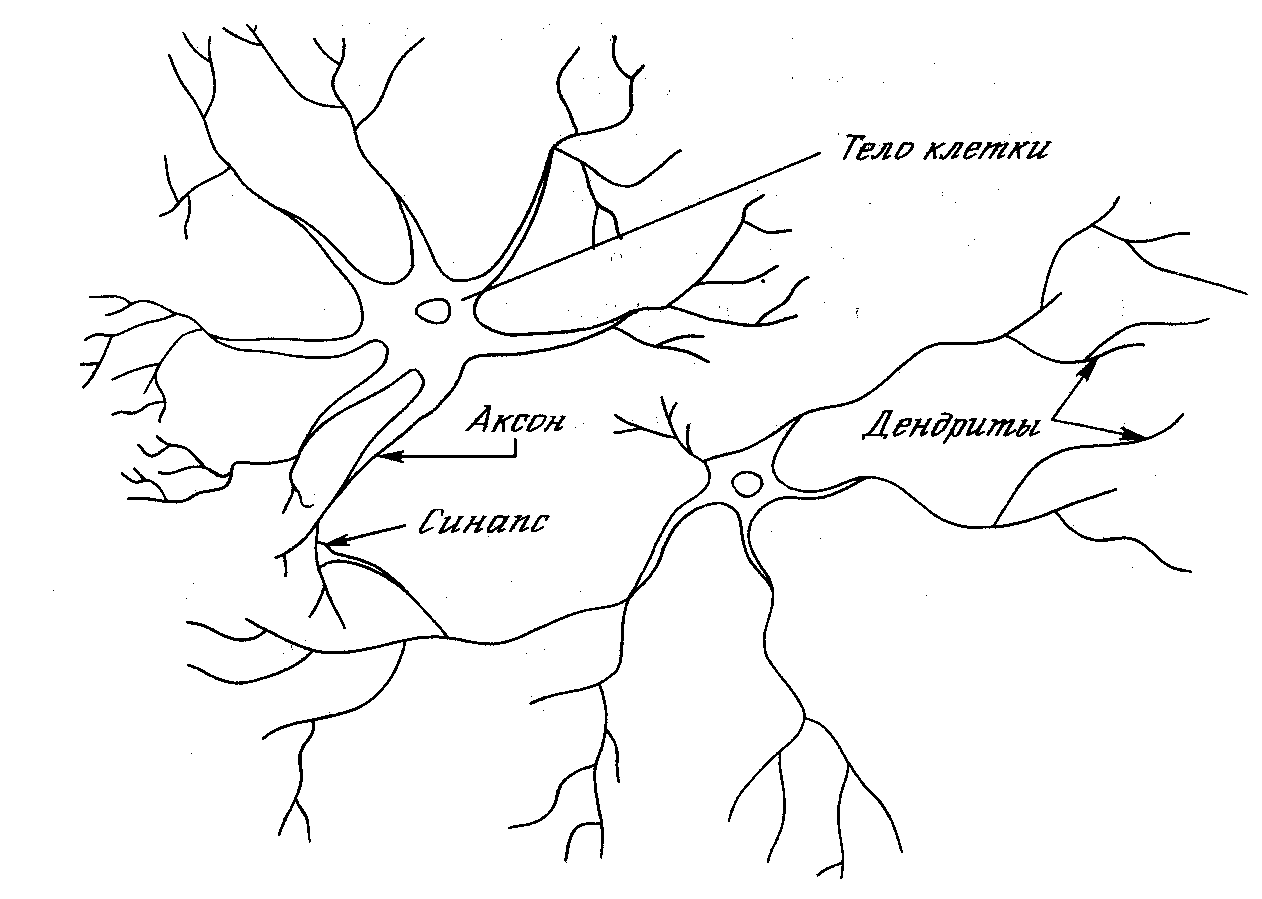

На рис. В.1 показана структура пары типичных биологических нейронов. Дендриты идут от тела нервной клетки к другим нейронам, где они принимают сигналы в точках соединения, называемых синапсами. Принятые синапсом входные сигналы подводятся к телу нейрона. Здесь они суммируются, причем одни входы стремятся возбудить нейрон, другие – воспрепятствовать его возбуждению. Когда суммарное возбуждение в теле нейрона превышает некоторый порог, нейрон возбуждается, посылая по аксону сигнал другим нейронам. У этой основной функциональной схемы много усложнений и исключений, тем не менее большинство искусственных нейронных сетей моделируют лишь эти простые свойства.

Рис. В.1. Биологический нейрон

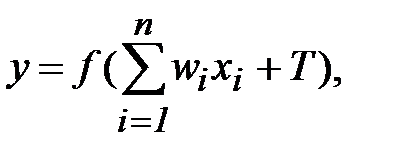

Основным элементом нейронной сети является нейрон, который осуществляет операцию нелинейного преобразования суммы произведений входных сигналов на весовые коэффициенты:

(1)

(1)

где X = (x1,x2,…,xn) – вектор входного сигнала; W=(w1,w2,…,wn) – весовой вектор; T – порог; f – так называемая функция активации.

Схема нейронного элемента изображена на рис. В.2. Каждому i -му входу нейрона соответствует весовой коэффициент wi (синапс), который характеризует силу синаптической связи по аналогии с биологическим нейроном.

Рис. В.2. Искусственный нейрон

Весовой вектор W, порог T и пороговая функция f определяют поведение любого нейрона – его реакцию на входные данные. Величина веса wi определяет степень влияния входа i на выход нейрона, а знак – характер влияния. Каждый из входов связан с некоторым источником информации (рецептор, формирующий признаки, распределительная ячейка, выход другого нейрона). Положительные веса характерны для возбуждающих связей, способствующих повышению активности нейрона. Отрицательные, как правило, соответствуют тормозящим связям.

Порог, если он используется, является характеристикой, задающей начальный уровень активности (при нулевом входе) и помогающей настроить нейрон на пороговую функцию. Изменение порога эквивалентно сдвигу пороговой функции по оси абсцисс. Ряд авторов [2] вводят дополнительный вход нейрона x0, всегда равный 1, и обозначают порог как его вес w0. Это позволяет упростить выражение (1) и математическую запись некоторых алгоритмов обучения. Однако на практике при программной реализации это не приводит к экономии времени и способствует ошибкам, кроме этого, порог может настраиваться иначе, чем весовой вектор.

Функция активации используется для ограничения выхода нейрона в заданном диапазоне и для нелинейного преобразования взвешенной суммы. Последнее позволяет нейронному классификатору аппроксимировать любую нелинейную границу между классами в пространстве образов. Функция активации выбирается для конкретной задачи и является неизменной характеристикой отдельного нейрона.

Могут использоваться следующие функции активации и их гибриды:

1) линейная функция y = Ax;

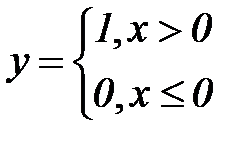

2) пороговая функция  ;

;

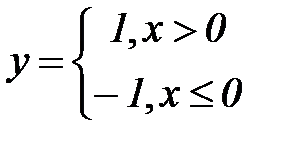

3) биполярная пороговая функция  ;

;

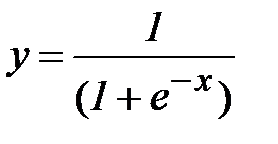

4) сигмоидная функция (рис. 1.2)

; (2)

; (2)

Рис. В.3. Сигмоидные функции активации

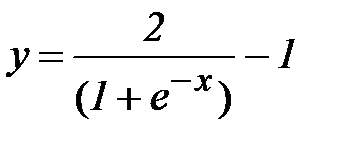

5) биполярная сигмоидная функция (рис. В.3)

; (3)

; (3)

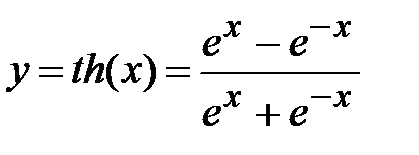

6) гиперболический тангенс (рис. В.4)

. (4)

. (4)

>

Рис. В.4. Гиперболический тангенс

Для классификаторов чаще всего применяют функции (2) – (4), поскольку они нелинейные и хорошо дифференцируются.

Веса и порог конкретного нейрона являются настраиваемыми параметрами. Они содержат знания нейрона, определяющие его поведение. Процесс настройки этих знаний с целью получения нужного поведения называется обучением.

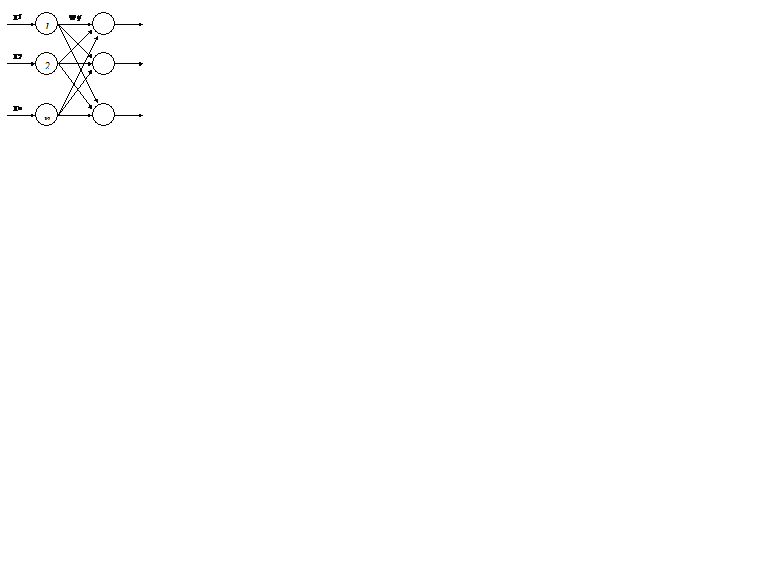

Нейронная сеть – совокупность нейронных элементов и связей между ними. Слоем нейронной сети называется множество нейронных элементов, на которые в каждый такт времени параллельно поступает информация от других нейронных элементов сети. Помимо слоев нейронов часто используется понятие входного распределительного слоя. Распределительный слой передает входные сигналы на первый обрабатывающий слой нейронных элементов

(рис. В.5).

Рис. В.5. Распределительный слой

У любой нейронной сети можно выделить 2 режима работы: обучение и воспроизведение. На этапе обучения настраиваются веса и пороги всех слоев. Воспроизведение является этапом обработки информации, следующим за обучением, при этом веса и пороги, как правило, не изменяются. Большое влияние на функционирование сети оказывает ее топология – архитектура слоев и связей между нейронами.

На способе обработки информации решающим образом сказывается наличие или отсутствие в сети обратных связей. Если обратных связей нет (каждый нейрон получает информацию только от нейронов предыдущих слоев), то обработка информации происходит в одном направлении за число тактов, равное числу слоев. При наличии обратных связей информация может проходить через сеть много раз до достижения какого-либо условия. В случае если условие достигнуто, говорят, что сеть стабилизировалась. В общем случае сходимость не гарантируется. Тем не менее наличие обратных связей позволяет решать задачи с привлечением меньшего числа нейронов, что ускоряет процесс обучения.

Для лучшего понимания данного вопроса приведем одну из возможных классификаций НС в зависимости от различных характеристик [2].

1. По типу входной информации:

· аналоговые НС (используют информацию в форме действительных чисел);

· двоичные НС (оперируют с информацией, представленной в двоичном виде).

2. По характеру обучения:

· с учителем (известно входное пространство решений НС);

· без учителя (НС формирует выходное пространство решений только на основе входных воздействий – самоорганизующиеся сети).

3. По характеру настройки синапсов:

· сети с фиксированными связями (весовые коэффициенты НС выбираются сразу, исходя из условия задачи);

· сети с динамическими связями (в процессе обучения происходит настройка синаптических связей).

4. По методу обучения:

· НС с алгоритмом обратного распространения ошибки;

· НС с конкурентным обучением;

· НС, использующие правило Хебба;

· НС с гибридным обучением, в которых используются различные алгоритмы обучения.

5. По характеру связей:

· НС с прямыми связями;

· НС с обратным распространением информации.

6. По архитектуре и обучению:

· персептронные сети с прямыми связями;

· самоорганизующиеся НС (НС Кохонена, НС адаптивного резонанса, рециркуляционные НС);

· НС с обратными связями (НС Хопфилда, НС Хэмминга, двунаправленная ассоциативная память, рекуррентные НС);

· гибридные НС (НС встречного распространения, НС с радиально-базисной функцией активации).

2015-04-12

2015-04-12 1135

1135