Очевидно, для возможности передачи информации от источника с помощью сигнала необходимо выполнение соотношения:

HИ ≤ nHC.

При этом имеют место 2 случая:

HИ = nHC – оптимальное согласование источника и сигнала;

HИ < nHC – возможность передачи от источника большего количества информации (избыточный сигнал).

Существует возможность выбора другого, более короткого сигнала, так как HC ≠ HCmax. Для этого нужно сократить число единичных элементов в сигнале с n до m: HИ = mHCmax.

Такое преобразование возможно и в первом случае. В приведенном выражении m – минимально возможное количество элементарных сигналов, которое можно получить при наличии источника с энтропией HИ, или число информационных элементов. Если n > m (HC < HCmax), то сигнал обладает избыточностью R:

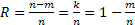

, где k – число избыточных элементов.

, где k – число избыточных элементов.

Относительно избыточности можно сказать следующее:

R < 1;

избыточность показывает, на какое число элементов (элементарных сигналов) можно сократить (сжать) исходный сигнал.

Всякое укорочение сигнала является важным результатом для любой системы. Чем короче сигнал, тем выше скорость передачи информации, меньше вероятность искажения сигнала, больше его мощность, меньше материальные расходы.

Оптимальное число элементов m получаем при равенстве вероятностей появления различных сообщений.

2015-05-06

2015-05-06 2187

2187