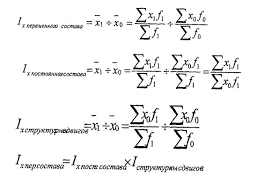

Рассмотрим на примере модели парной регрессии (однофакторной):  ,и

,и  , условия ГМ соблюдены

, условия ГМ соблюдены

1. Если значение  известно (так в жизни не бывает).

известно (так в жизни не бывает).

Тогда  , а

, а

Вычтем из первого второе, помноженное на  , получим:

, получим:

, t=2,3,4,....,n.

, t=2,3,4,....,n.

В данной регрессии ошибки подчинены условиям Г-М, значит все статистические выводы применимы, как к стандартной регрессии c константой. Здесь теряется одно наблюдение (первое), однако при больших объёмах выборки такая модель (названная Cochrane-Orcutt) несильно искажает оценки и предпочтительна (так как в ней есть константа).

Если не хочется терять первое наблюдение, то:

Умножим уравнение при t=1 на  , получим:

, получим:  ,

,

Проведём замену, введём новые факторы:

Получим новую регрессию:

Это будет регрессия без автокорреляции ошибок, оценки OLS коэффициентов будут наилучшими (BLUE оценки), для неё будут верны стандартные статистические выводы для модели без константы, но из-за того, что это модель без константы, такое преобразование (преобразование Prais-Winsten,1954) не столь предпочтительно, сколь Cochrane-Orcutt.

2015-05-27

2015-05-27 572

572