Тема 3. Парная регрессия и корреляция[2].

- статистическая зависимость (независимость) случайных переменных. Ковариация.

- Анализ линейной статистической связи экономических данных, корреляция; вычисление коэффициентов корреляции.

- линейная модель парной регрессии.

- Оценка параметров модели с помощью метода наименьших квадратов (МНК).

- Оценка существенности параметров линейной регрессии.

- Интервалы прогноза по линейному уравнению регрессии.

Материал данной темы частично знаком студентам и подробно изложен в учебном пособии [1] стр. 170 -176 и 190 - 207.

Рассматривая зависимости между признаками, необходимо выделить, прежде всего, две категории зависимости: 1) функциональные и 2) корреляционные.

Функциональные связи характеризуются полным соответствием между изменением факторного признака и изменением результативной величины, и каждому значению признака-фактора соответствуют вполне определенные значения результативного признака. Функциональная зависимость может связывать результативный признак с одним или несколькими факторными признаками. Так, величина начисленной заработной платы при повременной оплате труда зависит от количества отработанных часов.

В корреляционных связях между изменением факторного и результативного признака нет полного соответствия, воздействие отдельных факторов проявляется лишь в среднем при массовом наблюдении фактических данных. Одновременное воздействие на изучаемый признак большого количества самых разнообразных факторов приводит к тому, что одному и тому же значению признака-фактора соответствует целое распределение значений результативного признака, поскольку в каждом конкретном случае прочие факторные признаки могут изменять силу и направленность своего воздействия.

Основная задача корреляционного анализа заключается в выявлении взаимосвязи между случайными переменными путем точечной и интервальной оценки парных (частных) коэффициентов корреляции, вычисления и проверки значимости множественных коэффициентов корреляции и детерминации. Кроме того, с помощью корреляционного анализа решаются следующие задачи: отбор факторов, оказывающих наиболее существенное влияние на результативный признак, на основании измерения степени связи между ними; обнаружение ранее неизвестных причинных связей. Корреляция непосредственно не выявляет причинных связей между параметрами, но устанавливает численное значение этих связей и достоверность суждений об их наличии.

При проведении корреляционного анализа вся совокупность данных рассматривается как множество переменных (факторов), каждая из которых содержит n –наблюдений.

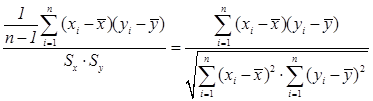

При изучении взаимосвязи между двумя факторами их, как правило, обозначают X=  и Y=

и Y=

.

ковариация - это статистическая мера взаимодействия двух переменных.

Например, положительное значение ковариации доходности двух ценных бумаг показывает, что доходности этих ценных бумаг имеют тенденцию изменяться в одну сторону.

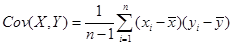

Ковариация между двумя переменными  рассчитывается следующим образом:

рассчитывается следующим образом:

,

,

где  - фактические значения случайных переменных x и y,

- фактические значения случайных переменных x и y,

.

.

Ковариация зависит от единиц, в которых измеряются переменные  .

.

Поэтому для измерения силы связи между двумя переменными используется другая статистическая характеристика, называемая коэффициентом корреляции.

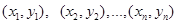

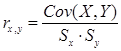

Вычисление коэффициента парной корреляции.

Коэффициент парной корреляции

Для двух переменных  коэффициент парной корреляции определяется следующим образом:

коэффициент парной корреляции определяется следующим образом:

=

=  , (1)

, (1)

где

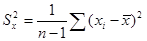

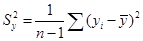

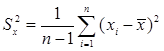

- оценки дисперсий величин

- оценки дисперсий величин  .

.

Дисперсия (оценка дисперсии)

характеризуют степень разброса значений  (

( ) вокруг своего среднего

) вокруг своего среднего  (

( , соответственно), или вариабельность (изменчивость) этих переменных на множестве наблюдений.

, соответственно), или вариабельность (изменчивость) этих переменных на множестве наблюдений.

В общем случае для получения несмещенной оценки дисперсии сумму квадратов следует делить на число степеней свободы оценки (n−p), где n - объем выборки, p - число наложенных на выборку связей. В данном случае p = 1, т.к. выборка уже использовалась один раз для определения среднего X, поэтому число наложенных связей равно единице, а число степеней свободы оценки (т.е. число независимых элементов выборки) равно (n −1).

Более естественно измерять степень разброса значений переменных в тех же единицах, в которых измеряется и сама переменная. Эту задачу решает показатель, называемый среднеквадратическим отклонением или стандартным отклонением, или стандартной ошибкой переменной Х (переменной Y), определяемый соотношением:

Слагаемые в числителе формулы (1) выражают взаимодействие двух переменных и определяют знак (положительной или отрицательной) корреляции. Если, например, между переменными существует сильная положительная взаимосвязь (увеличение одной переменной при увеличении второй), каждое слагаемое будет положительным числом. Аналогично, если между переменными существует сильная отрицательная взаимосвязь, все слагаемые в числителе будут отрицательными числами, что в результате дает отрицательное значение корреляции.

Знаменатель выражения для коэффициента корреляции просто нормирует числитель таким образом, что коэффициент корреляции оказывается легко интерпретируемым числом, не имеющим размерности, в диапазоне от -1 до 1.

Числитель выражения для коэффициента корреляции, который трудно интерпретировать из-за необычных единиц измерения, называется ковариацией Х и Y. Несмотря на то, что иногда он используется как самостоятельная характеристика (например, в теории финансов для описания совместного изменения курсов акций на двух биржах), удобнее пользоваться коэффициентом корреляции. Корреляция и ковариация представляют, по сути, одну и ту же информацию, однако корреляция представляет эту информацию в более удобной форме.

Следует отметить, что величина коэффициента корреляции не является доказательством наличия причинно-следственной связи между исследуемыми признаками, а является оценкой степени взаимной согласованности в изменениях признаков. Установлению причинно-следственной зависимости предшествует анализ качественной природы явлений. Но есть и еще одно обстоятельство, объясняющее формулировку выводов о возможном наличии связи по величине коэффициента корреляции.

Связано это с тем, что оценка степени тесноты связи с помощью коэффициента корреляции производится, как правило, на основе более или менее ограниченной информации об изучаемом явлении. Возникает вопрос, насколько правомерно наше заключение по выборочным данным в отношении действительного наличия корреляционной связи в той генеральной совокупности, из которой была произведена выборка?

Принципиально возможны случаи, когда отклонение от нуля полученной величины выборочного коэффициента корреляции оказывается целиком, обусловленным неизбежными случайными колебаниями тех выборочных данных, на основании которых он вычислен. Особенно осторожно следует подходить к истолкованию полученных коэффициентов корреляции при незначительных объемах выборочной совокупности.

В этой связи и возникает необходимость оценки существенности линейного коэффициента корреляции, дающая возможность распространить выводы по результатам выборки на генеральную совокупность. В зависимости от объема выборочной совокупности предлагаются различные методы оценки существенности линейного коэффициента корреляции.

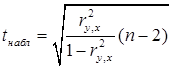

Оценка значимости коэффициента корреляции при малых объемах выборки выполняется с использованием t - критерия Стьюдента. При этом фактическое (наблюдаемое) значение этого критерия определяется по формуле:

Вычисленное по этой формуле значение tнабл сравнивается с критическим значением t-критерия, которое берется из таблицы значений t Стьюдента с учетом заданного уровня значимости и числа степеней свободы (n-2).

Если tнабл > tкр, то полученное значение коэффициента корреляции признается значимым (то есть нулевая гипотеза, утверждающая равенство нулю генерального коэффициента корреляции, отвергается). И таким образом делается вывод о том, что между исследуемыми переменными есть тесная статистическая взаимосвязь.

Удобным графическим средством анализа парных данных является диаграмма рассеяния, которая представляет каждое наблюдение в пространстве двух измерений, соответствующих двум факторам.

Диаграмму рассеяния, на которой изображается совокупность значений двух признаков, называют еще корреляционным полем. Каждая точка этой диаграммы имеет координаты Xi и Yi. По мере того, как возрастает сила линейной связи, точки на графике будут лежать более близко к прямой линии, а величина r будет ближе к 1.

Парная регрессия

Регрессионный анализ[3] занимает ведущее место в математике статистических методах эконометрики. До регрессионного анализа следует проводить корреляционный анализ, в процессе которого оценивается степень тесноты статистической связи между исследуемыми переменными. От степени тесноты связи зависит прогностическая сила регрессионной модели.

Регрессионный анализ предназначен для исследования зависимости исследуемой переменной от различных факторов и отображения их взаимосвязи в форме регрессионной модели.

В регрессионных моделях зависимая (объясняемая) переменная Y может быть представлена в виде функции f ( ), где

), где  - независимые (объясняющие) переменные, или факторы.

- независимые (объясняющие) переменные, или факторы.

Связь между переменной Y и k независимыми факторами Х можно охарактеризовать функцией регрессии Y= f ( ), которая показывает, каково будет в среднем значение переменной yi, если переменные Xi примут конкретные значения.

), которая показывает, каково будет в среднем значение переменной yi, если переменные Xi примут конкретные значения.

Данное обстоятельство позволяет использовать модель регрессии не только для анализа, но и для прогнозирования экономических явлений.

Сформулируем регрессионную задачу для случая одного факторного признака.

Пусть имеется набор значений двух переменных: Y= - объясняемая переменная и X=

- объясняемая переменная и X=  - объясняющая переменная, каждая из которых содержит n наблюдений.

- объясняющая переменная, каждая из которых содержит n наблюдений.

Пусть между переменными X=  и Y=

и Y= теоретически существует некоторая линейная зависимость

теоретически существует некоторая линейная зависимость

.

.

Данное уравнение будем называть «истинным» уравнением регрессии.

Однако в действительности между X и Y наблюдается не столь жесткая связь. Отдельные наблюдения  будут отклоняться от линейной зависимости в силу воздействия различных причин. Обычно зависимая переменная находится под влиянием целого ряда факторов, в том числе и не известных исследователю, а также случайных причин (возмущения и помехи); существенным источником отклонений в ряде случаев являются ошибки измерения. Отклонения от предполагаемой формы связи, естественно, могут возникнуть и в силу неправильного выбора вида самого уравнения, описывающего эту зависимость. Учитывая возможные отклонения, линейное уравнение связи двух переменных (парную регрессию) представим в виде

будут отклоняться от линейной зависимости в силу воздействия различных причин. Обычно зависимая переменная находится под влиянием целого ряда факторов, в том числе и не известных исследователю, а также случайных причин (возмущения и помехи); существенным источником отклонений в ряде случаев являются ошибки измерения. Отклонения от предполагаемой формы связи, естественно, могут возникнуть и в силу неправильного выбора вида самого уравнения, описывающего эту зависимость. Учитывая возможные отклонения, линейное уравнение связи двух переменных (парную регрессию) представим в виде

, (2)

, (2)

где  - постоянная величина (или свободный член уравнения),

- постоянная величина (или свободный член уравнения),  - коэффициент регрессии, определяющий наклон линии, вдоль которой рассеяны данные наблюдений. Это показатель, характеризующий изменение переменной

- коэффициент регрессии, определяющий наклон линии, вдоль которой рассеяны данные наблюдений. Это показатель, характеризующий изменение переменной  , при изменении значения

, при изменении значения  на единицу. Если

на единицу. Если  - переменные

- переменные  и

и  положительно коррелированные, если

положительно коррелированные, если  < 0 – отрицательно коррелированны;

< 0 – отрицательно коррелированны;  - случайная переменная, или случайная составляющая, или остаток, или возмущение. Она отражает тот факт, что изменение

- случайная переменная, или случайная составляющая, или остаток, или возмущение. Она отражает тот факт, что изменение  будет неточно описываться изменением Х – присутствуют другие факторы, неучтенные в данной модели.

будет неточно описываться изменением Х – присутствуют другие факторы, неучтенные в данной модели.

Таким образом, в уравнении (2) значение каждого наблюдения  представлено как сумма двух частей — систематической

представлено как сумма двух частей — систематической  и случайной

и случайной  . В свою очередь систематическую часть можно представить в виде уравнения

. В свою очередь систематическую часть можно представить в виде уравнения

Можно сказать, что общим моментом для любой эконометрической модели является разбиение зависимой переменной на две части — объясненную и случайную.

.

.

2014-02-04

2014-02-04 3597

3597