При решении самых разнообразных задач (инженерных, экономических, научных) нередко возникает потребность подобрать непрерывную функцию,

наиболее точно выражающую фактически наблюдаемые взаимосвязи между параметрами.

Предположим, что имеется набор пар данных типа вход-выход {(x1,y1), (x2,y2),..., (xn,yn)}, которые генерируются неизвестной функцией, искаженной шумом. Задача аппроксимации состоит в нахождении неизвестной функции у = F(x), которая в точках x1, x2, xn принимает значения, как можно более близкие к y1, y2,..., yn.

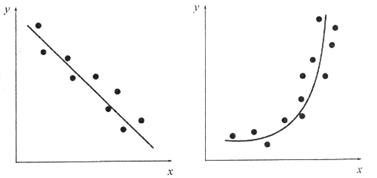

На практике вид искомой функции чаще всего определяют с помощью точечного графика, позволяющего наглядно проследить характер зависимости между входными и выходными параметрами.

Так, на рисунке видно, что на графике слева взаимосвязь переменных близка к линейной; поэтому фактические значения лучше всего аппроксими- руются прямой линией. Отклонения от этой линии можно интерпретировать как случайные колебания. Напротив, на графике справа реальная взаимосвязь величин х и у явно имеет нелинейный характер: какую бы прямую линию мы ни провели, отклонения точек от нее будут слишком большими, чтобы считаться случайными. В данном случае необходимо использовать параболу второго или третьего порядка, и тогда можно получить достаточно хорошее приближение (рис. 7.12).

Рисунок 7.12 – Взаимосвязь переменных

Ситуация заметно осложняется, когда необходимо проанализировать зависимость выходной переменной у не от одной, а от нескольких входных переменных сразу. В этом случае аппроксимация осуществляется с помощью многомерной функции у = F(x), где х = [ x1, x2, xn ] – вектор с n компонентами. Естественно, графический метод, позволяющий использовать для решения

задачи геометрическую интуицию, здесь не подходит. Модели на основе ис- кусственных нейронных сетей снимают эту проблемы, поскольку:

– доказано, что нейронные сети – универсальные аппроксиматоры, и позволяют имитировать любую непрерывную функцию с заданной точностью;

– исследователь избавлен от необходимости самостоятельно выдвигать гипотезы о виде приближающей функции;

– существуют быстрые алгоритмы обучения соответствующих нейронных сетей.

В силу указанных причин нейронные сети стали широко использоваться при решении сложных задач, требующих построения аппроксимирующих зависимостей.

2015-04-30

2015-04-30 1322

1322