Если факторные признаки различны по своей сущности и/или имеют различные единицы измерения, то коэффициенты регрессии  при разных факторах являются несопоставимыми. Поэтому уравнение регрессии дополняют соизмеримыми показателями тесноты связи фактора с результатом, позволяющими ранжировать факторы. К ним относят: частные коэффициенты эластичности, β-коэффициенты, частные коэффициенты корреляции.

при разных факторах являются несопоставимыми. Поэтому уравнение регрессии дополняют соизмеримыми показателями тесноты связи фактора с результатом, позволяющими ранжировать факторы. К ним относят: частные коэффициенты эластичности, β-коэффициенты, частные коэффициенты корреляции.

Парные коэффициенты корреляции. Для измерения тесноты связи между двумя из рассматриваемых переменных (без учета их взаимодействия с другими переменными) применяются парные коэффициенты корреляции. Методика расчета таких коэффициентов и их интерпретации аналогичны линейному коэффициенту корреляции в случае однофакторной связи.

- среднее квадратическое отклонение факторного признака;

- среднее квадратическое отклонение факторного признака;

среднее квадратическое отклонение результативного признака.

среднее квадратическое отклонение результативного признака.

Коэффициент частной корреляции измеряет тесноту линейной связи между отдельным фактором и результатом при устранении воздействия прочих факторов модели.

Для качественной оценки тесноты связи можно использовать следующую классификацию:

0.1- 0.3- слабая связь

0.3-0.5 – умеренная связь

0.5-0.7- заметная связь

0.7-0.9- тесная связь

0.9-0.99- весьма тесная

Для расчета частных коэффициентов корреляции могут быть использованы парные коэффициенты корреляции.

Для случая зависимости Y от двух факторов можно вычислить 2 коэффициента частной корреляции:

(2-ой фактор

(2-ой фактор  фиксирован);

фиксирован);

(1-ый фактор

(1-ый фактор  фиксирован).

фиксирован).

Это коэффициенты частной корреляции 1-ого порядка (порядок определяется числом факторов, влияние которых на результат устраняется).

Частные коэффициенты корреляции, рассчитанные по таким формулам изменяются от -1 до +1. Они используются не только для ранжирования факторов модели по степени влияния на результат, но и также для отсева факторов. При малых значениях  нет смысла вводить в уравнение m-ый фактор, т.к. качество уравнения регрессии при его введении возрастет незначительно (т.е. теоретический коэффициент детерминации увеличится незначительно).

нет смысла вводить в уравнение m-ый фактор, т.к. качество уравнения регрессии при его введении возрастет незначительно (т.е. теоретический коэффициент детерминации увеличится незначительно).

Совокупный коэффициент множественной корреляции или индекс множественной корреляцииопределяет тесноту совместного влияния факторов на результат:

остаточная дисперсия;

остаточная дисперсия;

. Он принимает значения от 0 до 1 (в отличие от парного коэффициента корреляции, который может принимать отрицательные значения, R используется без учета направления связи). Чем плотнее фактические значения

. Он принимает значения от 0 до 1 (в отличие от парного коэффициента корреляции, который может принимать отрицательные значения, R используется без учета направления связи). Чем плотнее фактические значения  располагаются относительно линии регрессии, тем меньше остаточная дисперсия и, следовательно, больше величина

располагаются относительно линии регрессии, тем меньше остаточная дисперсия и, следовательно, больше величина  . Таким образом, при значении R близком к 1, уравнение регрессии лучше описывает фактические данные и факторы сильнее влияют на результат; при значении Rблизком к 0 уравнение регрессии плохо описывает фактические данные и факторы оказывают слабое воздействие на результат.

. Таким образом, при значении R близком к 1, уравнение регрессии лучше описывает фактические данные и факторы сильнее влияют на результат; при значении Rблизком к 0 уравнение регрессии плохо описывает фактические данные и факторы оказывают слабое воздействие на результат.

При трех переменных для двух факторного уравнения регрессии данная формула совокупного коэффициента множественной корреляции легко приводится к следующему виду:

Чем R ближе к единице, тем совокупное влияние изучаемых показателей x1 и x2 на результативный факторy больше (корреляционная связь более интенсивная).

Множественный (совокупный) коэффициент детерминации определим как квадрат множественного коэффициента корреляции. Показывает, какая доля вариации изучаемого показателя объясняется влиянием факторов, включенных в уравнение множественной регрессии. Его значение - в пределах от нуля до единицы. Чем ближе множественный коэффициент детерминации к единице, тем вариация изучаемого показателя в большей мере характеризуется влиянием отобранных факторов.

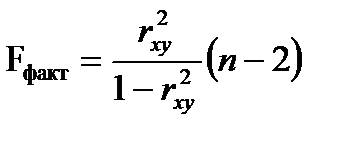

26. F-тест - оценивание качества уравнения регрессии - состоит в проверке гипотезы Н0 о статистической незначимости уравнения регрессии и показателя тесноты связи. Для этого выполняется сравнение фактического Fфакт и критического (табличного) Fтабл значений F-критерия Фишера. Fфакт определяется как

где n — число единиц совокупности;

m - число параметров при переменных х

Fтабл – это максимально возможное значение критерия под влиянием случайных факторов при данных степенях свободы и уровне значимости а. Уровень значимости а - вероятность отвергнуть правильную гипотезу при условии, что она верна.

Если Fтабл<Fфакт, то Н0 - гипотеза о случайной природе оцениваемых характеристик отклоняется и признается их статистическая значимость и надежность. Если Fтабл>Fфакт, то гипотеза Н0 не отклоняется и признается статистическая незначимость, ненадежность уравнения регрессии.

2015-05-18

2015-05-18 2403

2403