При гетероскедастичности и автокорреляции остатков часто используется традиционный МНК заменять обобщенным МНК.

Обобщенный МНК применятся к преобразованным данным и позволяет получать несмещенные и эффективные оценки.

Рассмотрим сначала коррекцию гетероскедастичности.

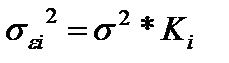

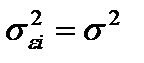

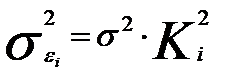

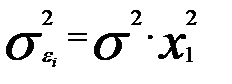

Как и раньше, предполагается, что м.о. остатков равно 0, а дисперсия их пропорциональная некоторой величине К, т.е.:

Как и раньше, будем предполагать, что среднее значение остаточных величин равно нулю. А вот дисперсия их не остается неизменной для разных значений фактора, а пропорциональна величине  , т.е.

, т.е.

,

,

Где  - дисперсия ошибки при конкретном i-м значении фактора;

- дисперсия ошибки при конкретном i-м значении фактора;

- постоянная дисперсия ошибки при соблюдении предпосылки о гомоскедастичности остатков;

- постоянная дисперсия ошибки при соблюдении предпосылки о гомоскедастичности остатков;

- коэффициент пропорциональности, меняющийся с изменением величины фактора, что и обусловливает неоднородность дисперсии.

- коэффициент пропорциональности, меняющийся с изменением величины фактора, что и обусловливает неоднородность дисперсии.

При этом предполагается, что  неизвестна, а в отношении величины К выдвигаются определенные гипотезы, характеризующие структуру гетероскедастичности.

неизвестна, а в отношении величины К выдвигаются определенные гипотезы, характеризующие структуру гетероскедастичности.

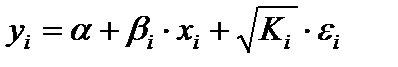

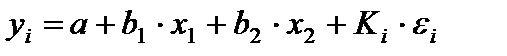

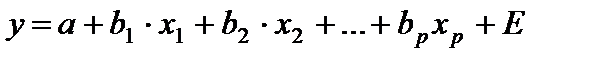

В общем виде для уравнения

Модель примет вид:

В ней остаточные величины гетероскедастичны. Предполагая в них отсутствие автокорреляции, можно перейти к уравнению с гомоскедастичными остатками, поделив все переменные, зафиксированные в ходе i-го наблюдения на  . Тогда дисперсия остатков будет величиной постоянной, т.е.

. Тогда дисперсия остатков будет величиной постоянной, т.е.  .

.

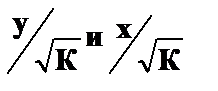

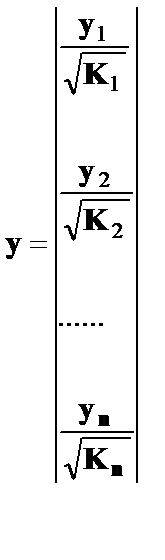

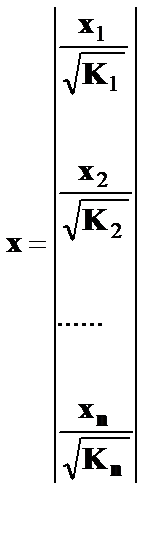

Иными словами, от регрессии у по x мы перейдем к регрессии на новых переменных:  .

.

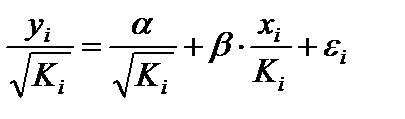

Уравнение регрессии примет вид:

Исходные данные для данного уравнения будут иметь вид:

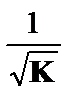

По отношению к обычной регрессии уравнение с новыми, преобразованными переменными представляет собой взвешенную регрессию, в которой переменные у и x взяты  .

.

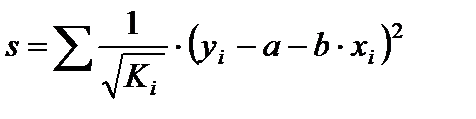

Оценка параметров нового уравнения с преобразованными переменными приводит к взвешенному методу наименьших квадратов, для которого необходимо минимизировать сумму квадратов отключений вида

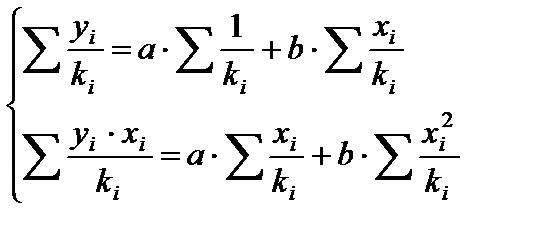

Соответственно получим следующую систему нормальных уравнений:

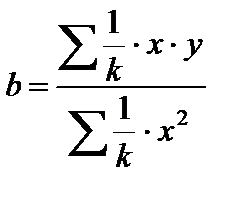

Если преобразованные переменные x и у взять в отклонениях от средних уровней, то коэффициент регрессии b можно определить как

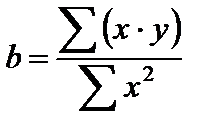

При обычном применении метода наименьших квадратов к уравнению линейной регрессии для переменных в отклонениях от средних уровней коэффициент регрессии b определяется по формуле

Как видим, при использовании обобщенного МНК с целью корректировки гетероскедастичности коэффициент регрессии b представляет собой взвешенную величину по отношению к обычному МНК с весами 1/К.

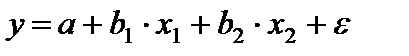

Аналогичный подход возможен не только для уравнения парной, но и для множественной регрессии. Предположим, что рассматривается модель вида

,

,

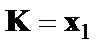

Для которой дисперсия остаточных величин оказалась пропорциональна  .

.  - представляет собой коэффициент пропорциональности, принимающий различные значения для соответствующих

- представляет собой коэффициент пропорциональности, принимающий различные значения для соответствующих  значений факторов

значений факторов  и

и  . Ввиду того, что

. Ввиду того, что

,

,

Рассматриваемая модель примет вид

,

,

Где ошибки гетероскедастичны.

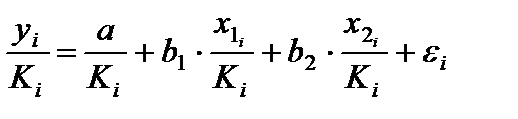

Для того чтобы получить уравнение, где остатки  гомоскедастичны, перейдем к новым преобразованным переменным, разделив все члены исходного уравнения на коэффициент пропорциональности К. уравнение с преобразованными переменными составит

гомоскедастичны, перейдем к новым преобразованным переменным, разделив все члены исходного уравнения на коэффициент пропорциональности К. уравнение с преобразованными переменными составит

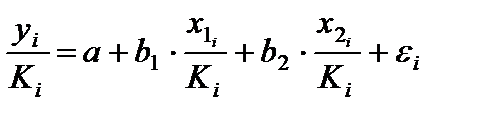

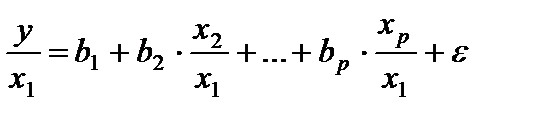

Это уравнение не содержит свободного члена. Вместе с тем, найдя переменные в новом преобразованном виде и применяя обычный МНК к ним, получим иную спецификацию модели:

Параметры такой модели зависят от концепции, принятой для коэффициента пропорциональности  . В эконометрических исследованиях довольно часто выдвигается гипотеза, что остатки

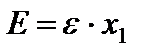

. В эконометрических исследованиях довольно часто выдвигается гипотеза, что остатки  пропорциональны значениям фактора. Так, если в уравнении

пропорциональны значениям фактора. Так, если в уравнении

Предположить, что  , т.е.

, т.е.  и

и  , то обобщенный МНК предполагает оценку параметров следующего трансформированного уравнения:

, то обобщенный МНК предполагает оценку параметров следующего трансформированного уравнения:

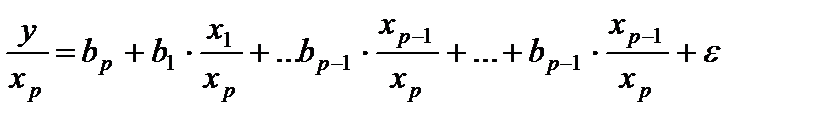

Если предположить, что ошибки пропорциональны  , то модель примет вид:

, то модель примет вид:

Применение в этом случае обобщенного МНК приводит к тому, что наблюдения с меньшими значениями преобразованных переменных х/К имеют при определении параметров регрессии относительно больший все, чем с первоначальными переменными. Вместе с тем следует иметь в виду, что новые преобразованные переменные получают новое экономическое содержание и их регрессия имеет иной смысл, чем регрессия по исходным данным.

2015-05-18

2015-05-18 917

917