1. Модель с двумя независимыми переменными.

2. Оценка коэффициентов модели множественной регрессии методом наименьших квадратов.

3. Парная и частная корреляция в модели множественной регрессии.

4. Оценка качества модели множественной регрессии.

5. Мультиколлинеарность и методы ее устранения.

6. Интерпретация коэффициентов модели множественной регрессии.

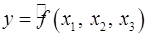

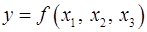

Множественная регрессия – это уравнение статистической связи с несколькими независимыми переменными:

y = f (x1, x2, xp)

где y – зависимая переменная (результативный признак);

x1, x2, xp – независимые переменные (факторы).

Построение уравнения множественной регрессии начинается с решения вопроса о спецификации модели. Он включает в себя два круга вопросов: отбор факторов и выбор вида уравнения регрессии.

Факторы, включаемые во множественную регрессию, должны отвечать следующим требованиям:

1. Они должны быть количественно измеримы. Если необходимо включить в модель качественный фактор, не имеющий количественного измерения, то ему нужно придать количественную определенность.

2. Факторы не должны быть интеркоррелированы и тем более находиться в точной функциональной связи.

Включаемые во множественную регрессию факторы должны объяснить вариацию независимой переменной. Если строится модель с набором  факторов, то для нее рассчитывается показатель детерминации

факторов, то для нее рассчитывается показатель детерминации  , который фиксирует долю объясненной вариации результативного признака за счет рассматриваемых в регрессии

, который фиксирует долю объясненной вариации результативного признака за счет рассматриваемых в регрессии  факторов. Влияние других, не учтенных в модели факторов, оценивается как

факторов. Влияние других, не учтенных в модели факторов, оценивается как  с соответствующей остаточной дисперсией

с соответствующей остаточной дисперсией  .

.

Отбор факторов обычно осуществляется в две стадии: на первой подбираются факторы исходя из сущности проблемы; на второй – на основе матрицы показателей корреляции определяют статистики для параметров регрессии.

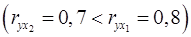

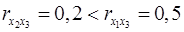

Коэффициенты интеркорреляции (т.е. корреляции между объясняющими переменными) позволяют исключать из модели дублирующие факторы. Считается, что две переменные явно коллинеарны, т.е. находятся между собой в линейной зависимости, если  . Если факторы явно коллинеарны, то они дублируют друг друга и один из них рекомендуется исключить из регрессии.

. Если факторы явно коллинеарны, то они дублируют друг друга и один из них рекомендуется исключить из регрессии.

Пусть, например, при изучении зависимости  матрица парных коэффициентов корреляции оказалась следующей:

матрица парных коэффициентов корреляции оказалась следующей:

|  |  |  | |

| 0,8 | 0,7 | 0,6 | |

| 0,8 | 0,8 | 0,5 | |

| 0,7 | 0,8 | 0,2 | |

| 0,6 | 0,5 | 0,2 |

Очевидно, что факторы  и

и  дублируют друг друга. В анализ целесообразно включить фактор

дублируют друг друга. В анализ целесообразно включить фактор  , а не

, а не  , хотя корреляция

, хотя корреляция  с результатом

с результатом  слабее, чем корреляция фактора

слабее, чем корреляция фактора  с

с

, но зато значительно слабее межфакторная корреляция

, но зато значительно слабее межфакторная корреляция  . Поэтому в данном случае в уравнение множественной регрессии включаются факторы

. Поэтому в данном случае в уравнение множественной регрессии включаются факторы  ,

,  .

.

По величине парных коэффициентов корреляции обнаруживается лишь явная коллинеарность факторов. Наибольшие трудности в использовании аппарата множественной регрессии возникают при наличии мультиколлинеарности факторов, когда более чем два фактора связаны между собой линейной зависимостью, т.е. имеет место совокупное воздействие факторов друг на друга. Наличие мультиколлинеарности факторов может означать, что некоторые факторы будут всегда действовать в унисон. В результате вариация в исходных данных перестает быть полностью независимой и нельзя оценить воздействие каждого фактора в отдельности.

Включение в модель мультиколлинеарных факторов нежелательно в силу следующих последствий:

1. Затрудняется интерпретация параметров множественной регрессии как характеристик действия факторов в «чистом» виде, ибо факторы коррелированы; параметры линейной регрессии теряют экономический смысл.

2. Оценки параметров ненадежны, обнаруживают большие стандартные ошибки и меняются с изменением объема наблюдений (не только по величине, но и по знаку), что делает модель непригодной для анализа и прогнозирования.

Для оценки мультиколлинеарности факторов может использоваться определитель матрицы парных коэффициентов корреляции между факторами.

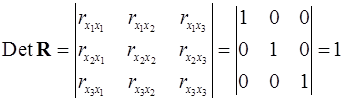

Если бы факторы не коррелировали между собой, то матрица парных коэффициентов корреляции между факторами была бы единичной матрицей, поскольку все недиагональные элементы

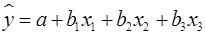

были бы равны нулю. Так, для уравнения, включающего три объясняющих переменных

были бы равны нулю. Так, для уравнения, включающего три объясняющих переменных

матрица коэффициентов корреляции между факторами имела бы определитель, равный единице:

.

.

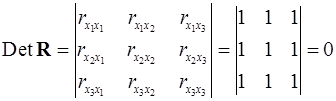

Если же, наоборот, между факторами существует полная линейная зависимость и все коэффициенты корреляции равны единице, то определитель такой матрицы равен нулю:

.

.

Чем ближе к нулю определитель матрицы межфакторной корреляции, тем сильнее мультиколлинеарность факторов и ненадежнее результаты множественной регрессии. И, наоборот, чем ближе к единице определитель матрицы межфакторной корреляции, тем меньше мультиколлинеарность факторов.

Самый простой путь устранения мультиколлинеарности состоит в исключении из модели одного или нескольких факторов. Другой подход связан с преобразованием факторов, при котором уменьшается корреляция между ними.

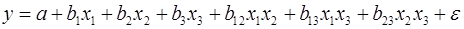

Одним из путей учета внутренней корреляции факторов является переход к совмещенным уравнениям регрессии, т.е. к уравнениям, которые отражают не только влияние факторов, но и их взаимодействие. Так, если  , то возможно построение следующего совмещенного уравнения:

, то возможно построение следующего совмещенного уравнения:

.

.

Рассматриваемое уравнение включает взаимодействие первого порядка (взаимодействие двух факторов). Возможно включение в модель и взаимодействий более высокого порядка, если будет доказана их статистическая значимость по  -критерию Фишера, но, как правило, взаимодействия третьего и более высоких порядков оказываются статистически незначимыми.

-критерию Фишера, но, как правило, взаимодействия третьего и более высоких порядков оказываются статистически незначимыми.

В зависимости от того, какая методика построения уравнения регрессии принята, меняется алгоритм ее решения на ЭВМ.

Наиболее широкое применение получили следующие методы построения уравнения множественной регрессии:

1. Метод исключения – отсев факторов из полного его набора.

2. Метод включения – дополнительное введение фактора.

3. Шаговый регрессионный анализ – исключение ранее введенного фактора.

2015-03-27

2015-03-27 18855

18855