Теория невероятностей,

Или

Размышление к информации

Информация и термодинамика

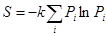

Примем за определение энтропии то, на котором остановился Больцман и с которого начал Шеннон: Энтропия является мерой количества равновероятных состояний термодинамической системы.

,

,

где i – количество степеней свободы системы, определяемое количеством частиц и количеством степеней свободы каждой частицы, Pi – вероятность каждого состояния частицы, k – постоянная Больцмана.

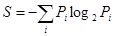

В информатике принят другой логарифмический масштаб – двоичный, и тогда

Обе эти формулы обозначают одну и ту же величину и равнозначны с точностью до постоянных коэффициентов, т.е. легко пересчитываются одна в другую.

Информация же, по Шеннону – мера уменьшения неопределенности, т.е. воздействие, уменьшающее количество равновероятных состояний системы. Таким образом, поступление информации в систему – это уменьшение ее энтропии:

Соответственно, для системы с фиксированным количеством частиц и их степеней свободы

Константа эта – своя для каждой системы и определяется ее внутренней структурой.

Будем считать информационным такое воздействие на систему, что оно:

- изменяет количество равновероятных состояний в системе, но при этом

- не изменяет количество частиц системы;

- не изменяет общую энергию системы;

- не изменяет температуру системы.

Обозначим первоначальную энтропию системы как S0, а энтропию после информационного воздействия S1. Таким образом,

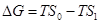

Согласно второму закону термодинамики, свободная энергия системы равна общей энергии за вычетом связанной энергии, которая определяется как произведение энтропии системы на ее температуру:

Обозначим изначальную свободную энергию системы как G0, а свободную энергию после информационного воздействия как G1. Тогда:

Вычтем второе уравнение из первого, получим изменение свободной энергии системы:

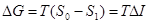

Отсюда:

Отсюда находим изменение информации в системе:

Словесно – приращение информации в системе прямо пропорционально свободной энергии и обратно пропорционально температуре.

Теперь вспомним термодинамическую суть температуры – она является мерой средней кинетической энергии одной частицы в системе:

,

,

где k – постоянная Больцмана.

Таким образом, можно представить температуру (безотносительно к масштабу, выражаемому постоянной Больцмана) как отношение общей кинетической энергии всех частиц системы к их количеству (с учетом степеней свободы каждой частицы):

, или проще:

, или проще:  , где Ek – суммарная кинетическая энергия всех частиц системы.

, где Ek – суммарная кинетическая энергия всех частиц системы.

Подставим эту формулу в выведенную нами формулу приращения информации и получим:

где N – величина, характеризующая количество микросостояний – т.е. частиц со своими степенями свободы. Таким образом, информация, как и энтропия, является аддитивной величиной, зависящей от общего количества микросостояний системы.

Что ожидаемо – для хранения информации необходимо иметь некоторое количество частиц, у которых можно увеличить их свободную энергию, причем потеря информации будет выражаться в увеличении кинетической энергии данных частиц. Проверяем размерность – энергетические составляющие формулы сокращаются, и остается размерность информации, выражающаяся в количестве задействованных частиц, имеющих некоторое количество степеней свободы (типичный пример – выражение информации в битах, т.е. частицах, имеющих ровно одну степень свободы с двумя состояниями, но возможно выражение информации в натах – натуральных единицах, или же в пересчете при помощи постоянной Больцмана – в энтропийных единицах).

В случае отсутствия новых информационных воздействий на систему и ее изоляции от обмена энергией справедлива формула:

Эта формула выражает известный нам из термодинамики закон неубывания энтропии. Слагаемое энтропийной составляющей при отсутствии внешних воздействий всегда неотрицательно, свободной энергии – соответственно всегда неположительно. Поскольку мы уже выявили зависимость информации от свободной энергии, формула будет выглядеть так:

В ней в случае, если слагаемое энтропии неотрицательно, слагаемое информации соответственно будет неположительным. Поэтому из второго закона термодинамики можно вывести закон невозрастания информации без внешнего информационного воздействия. Некоторые авторы называют этот закон неравенством обработки информации – при любых операциях с сообщениями их информация в наилучшем случае не теряется, в остальных – количество информации в конце операции всегда меньше начального:

Интересно в этом плане замечание Д.С. Чернавского (см.) о нестандартной формулировке второго закона термодинамики – при расчетах поведения системы частиц по необходимости допускается существование ошибок, совокупность которых дает меру случайности в поведении системы, которую можно вводить как энтропию системы, но введение этого понятия методологически необязательно. То есть – энтропия напрямую может рассматриваться как неизбежный недостаток информации о поведении системы, что соответствует тезису Колмогорова (см.) о том, что термодинамика и статистическая физика являются следствиями теории информации.

Эти необходимо возникающие ошибки – не просто математическое допущение, а физический смысл поведения системы – стремления к необратимому состоянию, которое в условиях замкнутости системы выражается к невозможности возвращения к начальным условиям.

В случае обмена системы энергией с внешней средой будет применимо уравнение Пригожина:

,

,

где индексы i и e - соответственные обозначения изменения внутренней энтропии и поступления энтропии извне. Это означает, что любое энергетическое воздействие на систему с постоянным количеством частиц и их степеней свободы, не являющееся по нашим критериям информационным, приводит к увеличению энтропии и соответственно – к потере информации.

То есть для получения системой информации нужно увеличить свободную и только свободную энергию системы, а сопряженное с получением энергии увеличение энтропии компенсировать ее отводом вовне системы – например, отводом тепла. Если такие условия соблюдаются, система приобретает стационарное неравновесное состояние, которое устойчиво до тех пор, пока в ней обеспечивается отвод энтропии, количественно равный ее приращению:

В этом случае потери информации системой компенсируются поступлением ее извне:

Разумеется, как и в случае других термодинамических идеализаций, «чистое» информационное воздействие невозможно. В случае получения системой извне свободной энергии происходит и получение энтропии – хотя бы в смысле теплопередачи. Приближение к идеальному информационному воздействию возможно, например, когда система обладает функцией терморегуляции – тепло, пришедшее в результате воздействия, отводится, а изменение свободной энергии частиц остается. Как пример можно привести работу компьютерного процессора с одновременным отводом тепла или запись информации на жесткий диск. Эти чисто практические примеры показывают, что не только математическое выражение, но и физическая сущность информационной энтропии и термодинамической энтропии одинакова – термодинамические процессы напрямую влияют на процессы передачи и хранения информации, и наоборот – из закономерностей необходимости потери информации в системе выводится второй закон термодинамики.

Выводы:

1. Информация как таковая является общим свойством материи, зависящим от количества ее частиц и их степеней свободы и запаса их свободной энергии.

2. Вследствие зависимости информации от количества частиц и их степеней свободы следует ее свойство аддитивности, идентичное таковому у энтропии. Слияние системы с другой приводит к увеличению количества информации, разделение системы – к разложению общей информации на сумму количеств информации получившихся систем.

3. Информация и энтропия – это взаимно противоположные величины, и в любой системе с фиксированным количеством частиц и их степеней свободы возрастание одной величины будет сопровождаться убыванием другой.

4. Вероятностный смысл информации – достижение системой наименее вероятных состояний, энтропии – стремление к наиболее вероятным состояниям.

5. Следствием закона неубывания энтропии (второго закона термодинамики) является закон невозрастания информации без внешнего информационного воздействия на систему (по другому – неравенство обработки информации). По предложению Колмогорова, считавшего первичной теорию информации, а термодинамику и статистическую физику – ее следствиями, можно наоборот, прямым утверждением считать закон невозрастания информации, а следствием – второй закон термодинамики.

6. Получение некоторыми частицами системы дополнительной кинетической энергии, выражающееся в повышении температуры, является причиной потери системой части своей информации, что на практике приводит к учету влияния температуры при проектировании систем связи или вычислительных систем.

7. Для получения информационного воздействия, приближающегося к идеальному, необходимо создать условия для получения системой свободной энергии и одновременного отвода полученной энтропии – как правило, в виде отвода тепла.

2015-04-06

2015-04-06 2076

2076